En marzo 2022, Meta eliminó un par de publicaciones en Facebook e Instagram criticandouna propuesta de ley de Carolina del Sur que habría horriblemente aplicado

penas por homicidio

a los solicitantes de aborto. Uno de los usuarios, partidario del acceso al aborto, expresó su frustración en Instagram y describió a los legisladores en cuestión como “tan pro- vida, te mataremos si te haces un aborto”. Esa publicación, y otra similar en Facebook, fue eliminada por Meta por violar sus políticas que prohiben amenazas de muerte.Casi al mismo tiempo, Meta eliminó otra publicación relacionada con el aborto proveniente de una perspectiva completamente diferente. En ese caso, un usuario de Facebook subió una foto de un par de manos extendidas junto al título: “Lógica pro-aborto», antes de burlarse de los defensores del aborto. “Nosotros no “No quiero que seas pobre, hambriento o no deseado”, decía la publicación. “Así que, en su lugar, simplemente te mataremos”. leyendo “Psicópatas…” siguió

abajo.

Las tres publicaciones ganaron la atención de La Junta de Supervisión, la entidad similar a la Corte Suprema de Meta responsable de opinar sobre los problemas de moderación de contenido más espinosos de la empresa. En una resolución de 18 páginas emitida

hoy y compartido con Gizmodo, la Junta de Supervisión anuló la decisión original de Meta de eliminar los tres publicaciones. Sin embargo, yendo un paso más allá, la Junta llamó a Meta a publicar Los datos que utilizó para evaluar la exactitud de la aplicación de sus políticas de violencia e incitación. La Junta quiere esos datos, dicen, en para determinar si

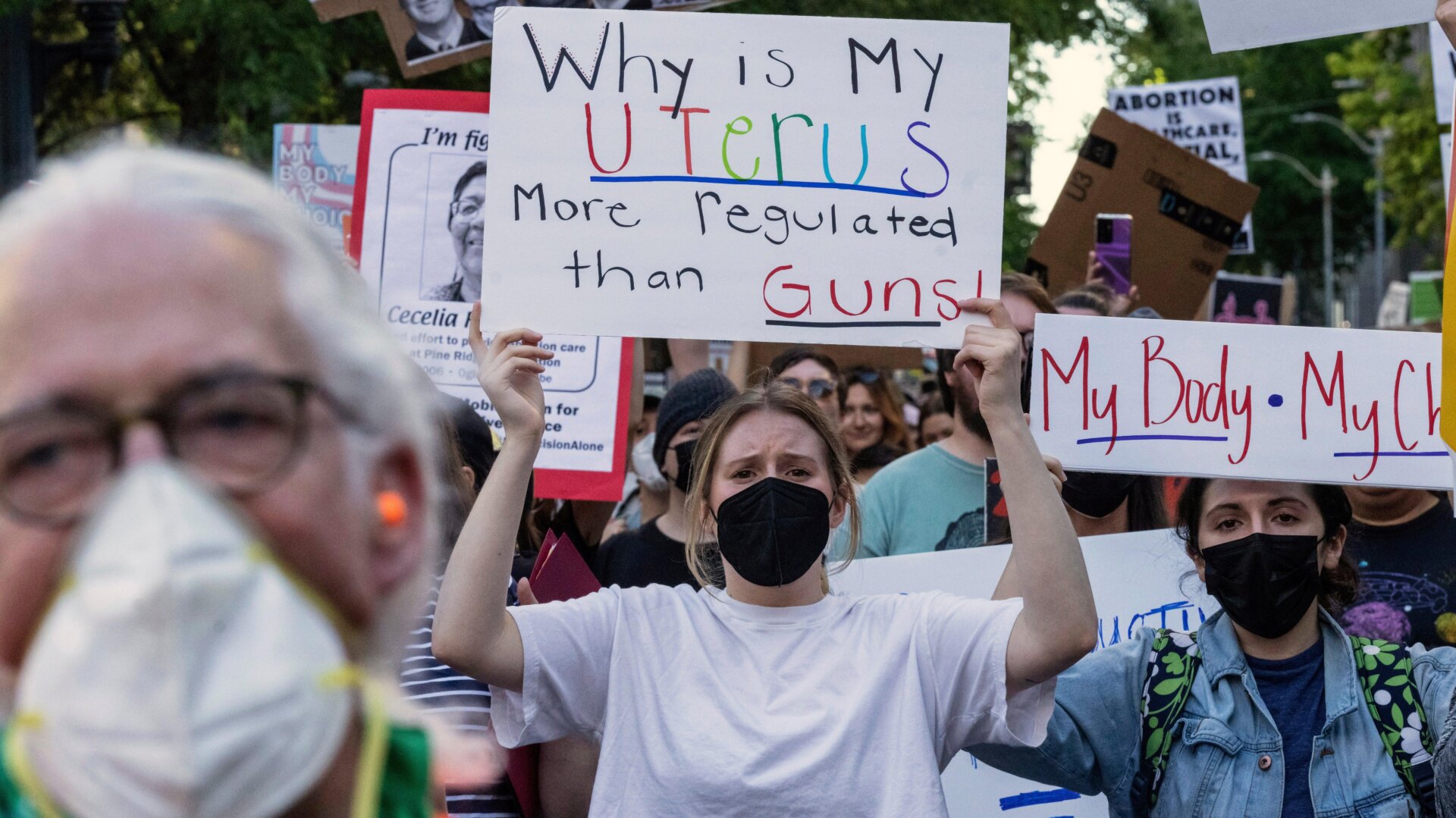

Estas publicaciones eliminadas por error eran valores atípicos. como Meta argumenta, o si son evidencia de una tendencia más amplia y persistente de aplicación excesiva de las leyes políticas.discurso en las redes sociales de la empresa. Por ahora, la Junta no parece convencida del argumento de Meta.“Meta no ha brindado a la Junta suficiente garantía de que los errores en estos casos sean valores atípicos, en lugar de ser representativos de un sistema patrón de inexactitudes», dijo la Junta.En su fallo, la Junta de Supervisión dijo que los debates sobre el aborto, particularmente tras la reversión de Roe V. Wade el verano pasado, se han vuelto más acusados y pueden involucrar amenazas que están claramente prohibidas bajo las políticas de Meta. Esos altos riesgos hacen que se garantice claridad en torno a lo que se considera violar las reglas.

aún más importante. Los errores y sesgos repetidos

por las políticas de aplicación automatizada de Meta, dijo la Junta, puede conducir a “patrones cíclicos de censura”. Eliminar por error contenido relacionado con el aborto que no en realidad viola las políticas de Meta, la Junta

añadido

, amenaza con perturbar el debate político silenciando voces.

Meta no respondió de inmediato a la solicitud de comentarios de Gizmodo, pero los miembros de la junta dijeron que la compañía les dijo que distinguir entre literal y no literal El uso del lenguaje violento es un desafío porque requiere la consideración de múltiples factores como la intención del usuario, los matices del lenguaje específicos del mercado, el sarcasmo, y humor”.el fallo de la junta

y solicitud de más datos

están claramente destinados a tenerimplicaciones más allá de estas tres publicaciones. La Junta de Supervisión dice que seleccionó las publicaciones porque resaltan el difícil desafío de la moderación de contenido que supone evaluar la retórica violenta cuando se utiliza como figura retórica. Ese lenguaje acalorado es particularmente pronunciado cuando se trata de peleas sobreaborto, pero podría extenderse fácilmente a otros discursos políticamente divisivos y de alto riesgo.

¿Por qué se eliminaron las publicaciones sobre aborto?

Cada una de las publicaciones bajo revisión fueron inicialmente eliminadas por los servicios de detección automatizados de Meta que escanean en busca de signos de “discurso hostil”. activó uno de los clasificadores de discurso hostiles automatizados del sistema y luego se envió a moderadores humanos para su revisión. Después de revisar las publicaciones, los moderadores confirmó la decisión del sistema automatizado y dijo que, de hecho, violaron las políticas de violencia e incitación de la empresa, específicamente aquellas que prohíben las amenazas de muerte. Meta finalmente revocó esas decisiones, pero solo después de que la Junta anunció que estaba considerando las apelaciones de los usuarios. Los usuarios apelaron la decisión de Meta en los tres casos, citando una variedad de razones que justifican su lenguaje agresivo. En su apelación, Facebook pro-elección El usuario argumentó que no estaban haciendo una amenaza, sino que más bien estaban resaltando la “lógica defectuosa” de los grupos que apoyan el acceso al aborto. Un seguidor en Facebook, por el contrario, argumentó que era común que Meta pasara por alto contextos cruciales en publicaciones relacionadas con el aborto. Algunos usuarios, dijeron. , optó por utilizar las palabras “de-life” o “no-vivo” para intentar y eludir los sistemas de detección automatizados de la empresa. Meta no lo hizo responder inmediatamente a la solicitud de comentario de Gizmodo.Un segundo par de moderadores humanos confirmó la decisión en las publicaciones de noticias del Grupo de Facebook y de Instagram, pero cuestionó la decisión en las noticias de Facebook. link case. Meta llamó a un tercer revisor humano en ese caso quien, una nueva , dijo esa pos