Según todos los indicios, la Ley de IA de la Unión Europea parece algo que haría felices a los éticos tecnológicos. ley de inteligencia artificial, que disfrutó de una enorme victoria legislativa esta semana, busca instituir un marco regulatorio amplio que aborde los daños que plantean las nuevas tecnología. En su forma actual, la ley haría todo lo posible para hacer que la IA sea más transparente, inclusiva y amigable para el consumidor en el países donde está en vigente. ¿Qué no gusta, verdad?

Entre otras cosas, la Ley de IA prohibiría los usos controvertidos de la IA, lo que considera sistemas de “alto riesgo”. sistemas de reconocimiento en el trabajo y en las escuelas, así como el tipo de sistemas de puntuación social que se han vuelto tan prevalentes en China. Al mismo tiempo, la ley también cuenta con salvaguardias que obligarían a las empresas que generan contenido multimedia con IA a revelar ese uso. a los consumidores.

El lunes, los reguladores de las tres ramas del bloque alcanzaron un acuerdo provisional sobre la ley, lo que significa que, a falta de una frase mejor, ya está hecho.

Y, sin embargo, a pesar de algunas victorias políticas, hay importantes puntos ciegos en la nueva ley, que hacen que los grupos de la sociedad civil sean más que un poco alarmado.

Damini Satija, jefa del Laboratorio de Responsabilidad Algorítmica de Amnistía Internacional, dijo que su organización y otras habían estado monitoreando cuidadosamente el desarrollo de la Ley de IA durante los últimos años y que, si bien hay mucho que celebrar en la nueva ley, no es suficiente.

De hecho, el propio Parlamento Europeo comunicado de prensa La ley sobre el hito admite que “[existen] excepciones limitadas para el uso de sistemas de identificación biométrica (RBI, por sus siglas en inglés)”: tecnología de vigilancia masiva policial, en otras palabras, “en espacios de acceso público para fines de aplicación de la ley, sujetos a autorización judicial previa y para listas de delitos estrictamente definidas”. Como parte de esa exención, la ley permite a la policía utilizar tecnología de reconocimiento facial en vivo—una herramienta controvertida que ha sido apodado “orwelliano” por su capacidad de monitorear y catalogar miembros del público, en casos donde se utiliza para prevenir “una amenaza terrorista específica y presente» o para identificar o encontrar a alguien que sea sospechoso de un delito.

Como se podría esperar, para grupos como Amnistía esto parece un punto ciego bastante grande. Desde la perspectiva de los críticos, no se sabe cómo El uso de estas tecnologías por parte de las fuerzas del orden podría crecer en el futuro. “Las exenciones de seguridad nacional, como sabemos por la historia, a menudo son solo una forma de Los gobiernos deben implementar sistemas de vigilancia bastante amplios”, afirmó Satija.

Satija también señala que la ley de la UE ha fracasado en otro área crítica. Si bien la ley prohíbe en particular ciertos tipos de IA de “alto riesgo”, , lo que no hace es prohibir la exportación de esa IA a otras naciones. En otras palabras, mientras que la mayoría de los europeos no lo harán estar sujeta a ciertos productos de vigilancia controvertidos, las empresas de la UE podrán vender esas herramientas a otros países fuera de la bloque. Amnistía ha señalado específicamente a las ventas de productos de vigilancia de las empresas de la UE al gobierno de China para vigilar a su población uigur, así como a Israel para mantener retener a los palestinos.

En las últimas semanas, Mher Hakobyan, asesora de Amnistía en materia de IA, ha liberado a varios declaraciones condenando aspectos de la ley. En referencia a sus excepciones en materia de aplicación de la ley, Akobian dijo que el bloque había dado luz verde a la “vigilancia digital distópica en los 27 Estados miembros de la UE, sentando un precedente devastador a nivel mundial en materia de regulación de la inteligencia artificial (IA). Por otro lado, demostró “un doble rasero flagrante por parte de los legisladores de la UE, quienes, por un lado, presentan a la UE como un líder global”. en la promoción de una ‘inteligencia’ artificial segura, confiable y ética y, por otro lado, se niegan a impedir que las empresas de la UE vendan sistemas de inteligencia artificial que violan los derechos al resto del mundo”, él dijo.

Otros grupos han expresado críticas similares. Christoph Schmon, Director de Políticas Internacionales de la Electronic Frontier Foundation, dijo que si bien son parte de la nueva La ley parecía “prometedora”, su enfoque hacia las tecnologías de aplicación de la ley era preocupante.

“La versión final del acuerdo aún está en proceso de cambio, pero es evidente que, a pesar de un lenguaje tan prometedor sobre la protección de los derechos fundamentales, Las nuevas regulaciones sobre vigilancia biométrica dejan muchas preguntas abiertas”, dijo Schmon en un correo electrónico. “Siempre hemos dicho que el reconocimiento facial por parte de los gobiernos representa una amenaza inherente a la privacidad individual, la libre expresión y la justicia social”, añadió. El acuerdo sobre IA parece hacer que la prohibición del reconocimiento facial en público y las restricciones a la vigilancia policial predictiva parezcan queso suizo. Mucho dependerá de los detalles técnicos de las negociaciones en curso y de cómo se apliquen estas normas en la práctica”.

Los detalles de la política de la Ley AI todavía se están afinando y el complejo proceso legislativo de la UE significa que todavía hay oportunidades para la letra pequeña cambiar, ligeramente. “Todavía queda bastante trabajo por hacer para finalizar el texto exacto y el diablo será “En los detalles”, dijo Satija. La versión final del proyecto de ley probablemente no estará finalizada hasta enero, dijo.

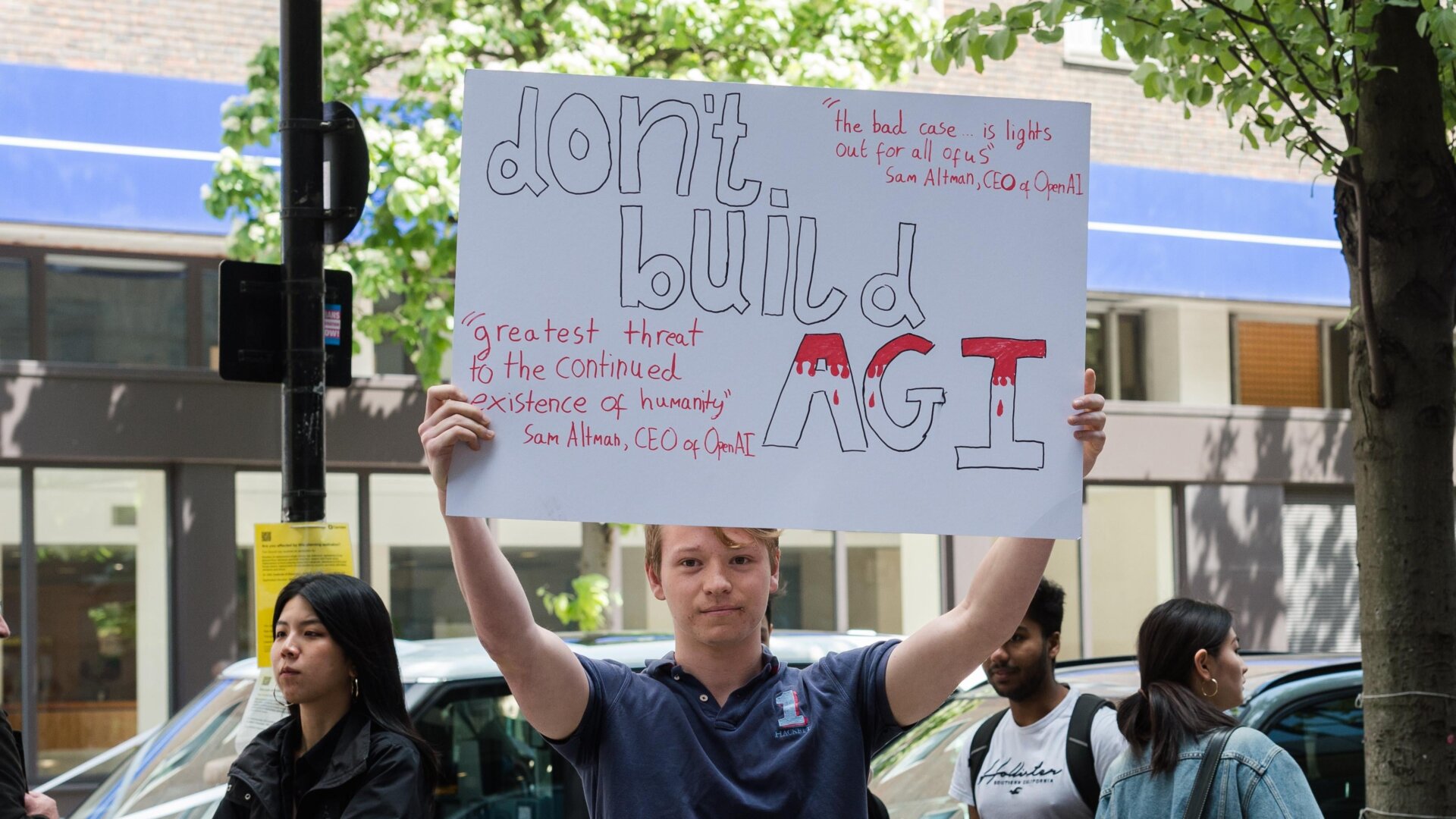

Para aquellos que siguen lo, el debate sobre la “seguridad de la IA” puede ser complicado y, a veces, bastante irritante. Ha habido una gran tendencia por parte de los líderes a hablar hasta las náuseas sobre los peligros que la IA plantea sin hacer mucho inmenso. Aunque la UE debería elogiarse por idear una ley que se enfrenta a muchos de los desafíos planteados por la inteligencia artificial, también parece algo irónico que hayan elegido ignorar los formas que parecen más probables de salirse de control y dañar a las personas. Después de todo, no se vuelve mucho más distópico que la vigilancia policial impulsada por IA. Si la gente se toma tan en serio la “seguridad” de la IA, ¿por qué estos casos de uso no son una primera prioridad para ¿reguladores?

Pregunta del día: ¿Qué pasa con el “multimodal”?

A principios de esta semana, la gente empezó a decir que el último modelo de lenguaje grande de OpenAI, GPT-4.5, se había filtrado en línea. Daniel Nyugen, quien publicó en X Sobre la supuesta filtración, describió que el LLM tiene “capacidades multimodales en lenguaje, audio, visión, video y 3D, además de complejos razonamiento y comprensión intermodal.» Aunque pareceesafuga en realidad es falso, una cosa que es real es que la industria de la IA está actualmente obsesionada con todo este asunto de la “multimodalidad”. Sistemas multimodales, Por lo que yo entiendo, son aquellos en los que se construye un sistema de IA utilizando una variedad de diferentes tipos de datos (como texto, imágenes, audio y video), permitiendo que el sistema exhiba habilidades “similares a las humanas”. integraciones recientes de ChatGPT (en las que ahora puede “hablar”, “escuchar” y “ver” cosas) son buenos ejemplos de multimodalidad. Actualmente se considera un trampolín hacia la AGI (inteligencia general artificial), que es el tan codiciado objetivo de la IA. desarrollo.

Más titulares esta semana

El director ejecutivo de Sports Illustrated queda fuera después del escándalo de los “periodistas” de AI. Ross Levinsohn, ahora ex director ejecutivo de Sports Illustrated, ha sido despedido por la empresa matriz de la publicación, el Grupo Arena, después de la distribución publicó varias historias generadas por IA usando firmas falsas. El escándalo es sólo el más reciente de una serie de incidentes similares en los que los medios de comunicación toman una decisión altamente poco ética intentar introducir contenido generado por IA en sus sitios web con la esperanza de que nadie se dé cuenta.

Microsoft quiere hacerse nuclear en la IA. Microsoft, la mediocre empresa de software fundada por Bill Gates, ha conseguido unirse a una estrella en ascenso en la industria de la IA (OpenAI), comprándose así otros varios años de relevancia cultural. Ahora, para impulsar las operaciones masivas de IA que las dos empresas están emprendiendo, Microsoft espera recurrir a una fuente de energía controvertida: la energía nuclear. reportado previamente que Microsoft estaba buscando una persona para “liderar iniciativas de proyectos para todos los aspectos de la infraestructura de energía nuclear para el crecimiento global”. Ahora, el Wall Street Journal informes que la empresa está intentando utilizar la IA para navegar por el complejo proceso regulatorio nuclear. Se sabe que ese proceso lleva años, por lo que Microsoft cree que automatizarlo podría ayudar.

El Papa está bastante preocupado por una dictadura de IA. El Papa Francisco ha estado reflexionando sobre los peligros del mundo moderno y, esta semana, intervino sobre la amenaza de una tecnocracia impulsada por la IA. El líder religioso pidió un tratado global vinculante que podría usarse para impedir que los “sistemas tecnocráticos” representen una “amenaza” para nuestra supervivencia”. Palabras duras. Supongo ese deepfakeen el que parecía drogado, realmente le afectó.