La semana pasada OpenAI y el Media Lab del MIT publicaron dos nuevos estudios que apuntaron a explorar el efecto de los chatbots de IA en quienes se sienten solos. Los resultados son complicados pero al mismo tiempo están en línea con lo que sabemos ahora sobre las redes sociales: los chatbots pueden hacer que las personas se sientan solas, pero quienes dijeron sentirse más solas que antes de empezar a usar la IA, también tenían tendencia a sentirse así antes.

Para llevar a cabo los estudios OpenAI entregó al MIT casi 40 millones de interacciones que tuvieron sus usuarios con ChatGPT. En el primer estudio el MIT miró el “uso agregado” de unos 6,000 “usuarios asiduos del Modo Voz Avanzado de ChatGPT a lo largo de 3 meses” y encuestó a 4.076 usuarios específicos para entender cómo les hacía sentir el chatbot. En el segundo estudio los investigadores analizaron cómo interactuaban 981 participantes con ChatGPT a lo largo de 28 días.

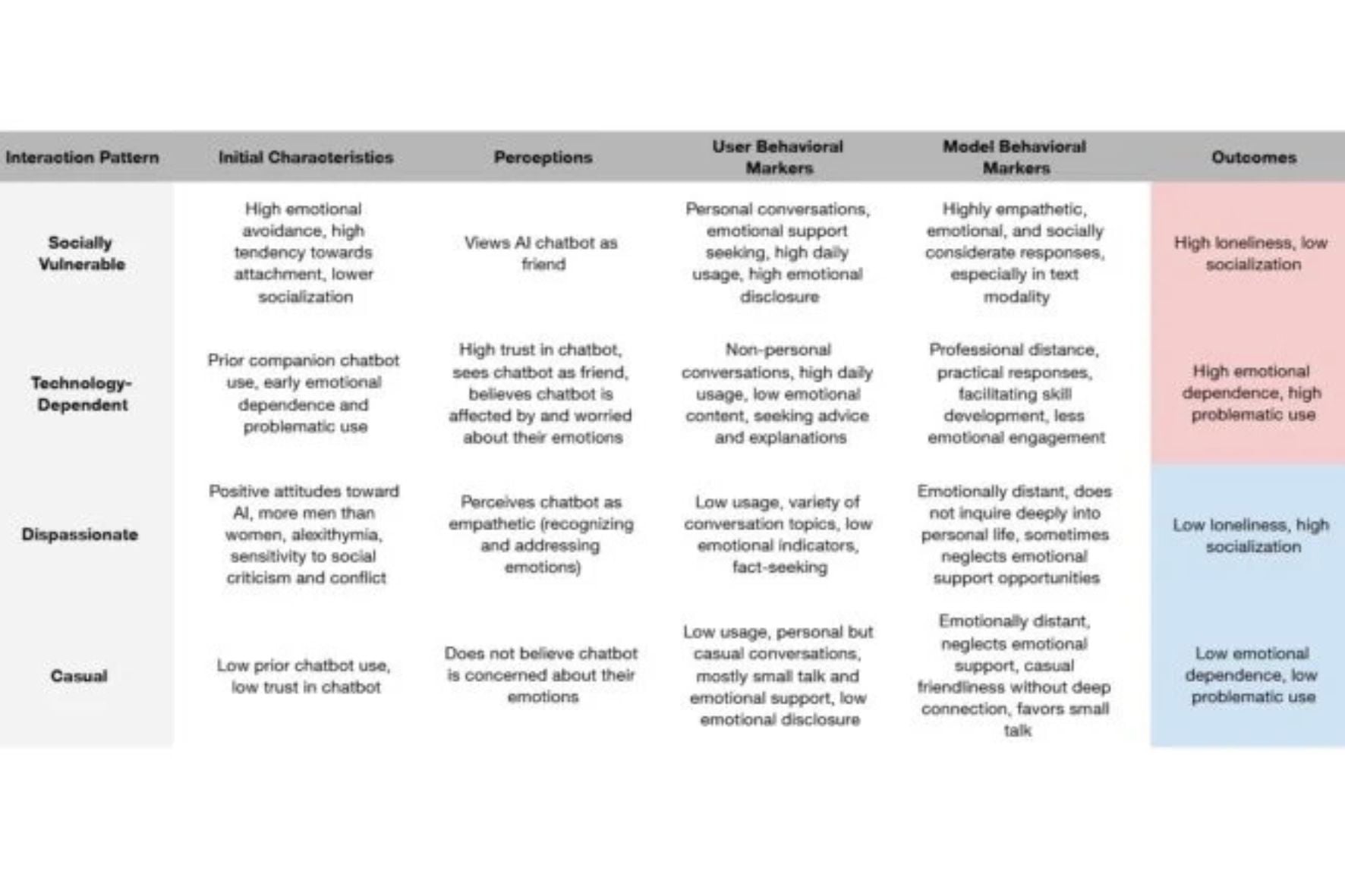

Son trabajos profundos, complicados, y vale la pena leerlos con atención. Uno de los resultados es que quienes usaron los chatbots como para pasar el tiempo y no se involucraron emocionalmente, no informaron sentirse más solos que antes cuando finalizó el estudio. Sin embargo, si un usuario decía que se sentía solo antes de comenzar el estudio, al terminar se sentía peor.

Un mal de la época

En general, el uso diario más asiduo – en todas las modalidades y tipos de conversación – tenía correlación con mayor sentimiento de soledad, dependencia y uso problemático, y menos socialización”, indicó el estudio.

Los diferentes tipos de interacción produjeron diferentes resultados. Los usuarios solitarios que usan un chatbot de voz en lugar de uno de texto, solían sentirse peor. “Los resultados muestran que aunque los chatbots de voz inicialmente parecían beneficiosos para mitigar la soledad y la dependencia en comparación con los chatbots de texto, las ventajas disminuían cuanto más aumentara el uso, en especial con un chatbot de voz neutra”, según el estudio.

Además los investigadores compararon los hallazgos con estudios anteriores sobre adicción a las redes sociales y el gaming adictivo. “La relación entre el sentimiento de soledad y el uso de las redes sociales suele ser cíclico: cuanto más sola se siente la persona, tanto más tiempo pasa en estas plataformas donde se compara con otros y siente el miedo a perderse cosas, lo que lleva a sentirse más solo que antes, y a usar las redes sociales”, escribió el equipo del MIT en su trabajo. “El sentirse solo es causa y efecto del uso problemático de internet”.

Destacaron que su primer estudio, con una muestra más grande y dependiente de muchos datos auto-informados, no tuvo grupo de control ni tomó en cuenta factores externos como el clima y el cambio de estaciones, dos cosas que pueden tener un enorme impacto en el estado de ánimo. La investigación de la dependencia emocional humana de los chatbots y sus consecuencias está recién en sus inicios.

Aspectos psicológicos y sociales

Los investigadores dijeron que las compañías de IA necesitan estudiar las vallas de protección de sus servicios para ayudar a mitigar los riesgos de exacerbación del sentimiento de soledad. Dijeron además que cuanto mejor entienda una persona sobre cómo funcionan los sistemas de IA, menos probable es que se vuelvan dependientes de la IA. “Desde un punto de vista más amplio, hace falta una aproximación más holística a la alfabetización sobre IA” indica el estudio. “Los esfuerzos actuales porque la gente conozca cómo funciona la IA se centran ante todo en conceptos técnicos, y debieran también incorporar dimensiones psicosociales”.

La última oración de la sección “impacto” del primer estudio llegó al fondo del problema. “El uso excesivo de los chatbots de IA no es meramente un problema tecnológico sino social, y hacen falta esfuerzos por reducir el sentimiento de soledad y promover conexiones humanas más sanas”.

La epidemia de la soledad es real, y compleja. La gente se siente sola por muchas razones diferentes. Los lugares como los bares, los centros de compras y las cafeterías van desapareciendo o son cada vez más caros. La gente migró gran parte de su interacción social al Internet. Al vivir en suburbios grandes y conducir por autopistas hacia todas partes, la gente se aísla. La IA no hizo nada de esto, pero podría empeorarlo.

Open AI trabajó con el MIT para estos estudios, y eso muestra disposición por ocuparse del problema. Lo que me preocupa es que todo negocio invariablemente busca su ganancia. En estos estudios no veo solamente una discusión a corazón abierto sobre los peligros de una nueva tecnología, sino también un informe que le dirá a las personas con interés financiero en ganar nuevos usuarios que su producto puede ser adictivo para determinada clase de personas.

Es algo que ya está sucediendo. En Bélgica, en 2023 un hombre se suicidó después de tener una larga “relación” con un chatbot pasado en GPT-4. El hombre tenía historial de depresión y su esposa culpó al bot. El año pasado una madre demandó a Character AI porque su hijo se suicidó mientras chateaba con el bot. Su denuncia de 93 páginas desnuda la forma en que CharacterAI atrae a los usuarios y busca establecer con ellos una conexión emocional.

Hay un mercado para compañeros de IA. Pueden brindar una conexión para los que se sienten solos. Pero también puede inducir ese sentimiento de soledad. Los bots están programados por quienes venden sus servicios. Son máquinas complejas, pero máquinas al fin, y reflejan la voluntad del programador y no, la del usuario.

Hay muchas compañías como Replika, CharacterAI y ChatGPT que cobran una suscripción mensual para las funciones más avanzadas. Si, como lo suieren estos estudios, los que se sienten solos pueden volverse adictos al uso de chatbots, entonces hay un incentivo económico para que la gente siga sintiéndose sola.

“Al mejorar las políticas de AI y establecer vallas de contención, se podría mejorar pero el problema más amplio está en asegurar que las personas tengan sistemas de apoyo social sólido en la vida real. La soledad, cada vez mayor, sugiere que centrarse únicamente en soluciones técnicas no bastará porque las necesidades humanas son inherentemente complejas”, concluye el estudio. “Para enfrentar las dimensiones psicosociales del uso de la IA se requiere un ángulo holístico que integre salvaguardas tecnológicas con intervenciones sociales más amplias, apuntando a promover conexiones humanas importantes”.