La inteligencia artificial avanza a un ritmo vertiginoso, pero algunos de los hombres que han estado en el centro de esta revolución tecnológica no están tranquilos. Demis Hassabis, fundador de Google DeepMind, y Ilya Sutskever, cofundador de OpenAI, han lanzado advertencias que no pueden ser ignoradas. Si quienes han dado forma a la IA temen sus consecuencias, ¿debería preocuparnos también?

«Me preocupa mucho»: La IA como una nueva bomba atómica

Demis Hassabis ha sido claro: el desarrollo de la inteligencia artificial le impide dormir. En una declaración que ha sacudido el mundo tecnológico, comparó la IA con la bomba atómica, sugiriendo que podría ser la tecnología más peligrosa creada por la humanidad. Su preocupación radica en la velocidad con la que evoluciona la IA y la falta de regulaciones adecuadas para controlarla.

El problema, según Hassabis, no es solo lo que la IA puede hacer hoy, sino lo que podría lograr mañana. Modelos cada vez más avanzados podrían tomar decisiones autónomas que escapen del control humano. ¿Nos encaminamos hacia un punto de no retorno?

«Nos tratarán como a los animales»: El futuro según Ilya Sutskever

Ilya Sutskever, cofundador de OpenAI, ha planteado una teoría aún más inquietante: si la IA supera la inteligencia humana, podría vernos de la misma forma en que nosotros vemos a los animales. Esta idea plantea un escenario escalofriante en el que la humanidad ya no estaría en la cumbre de la cadena evolutiva.

Según Sutskever, los sistemas de IA podrían llegar a desarrollar intereses propios, y si estos no están alineados con los nuestros, el futuro de la especie podría estar en riesgo. ¿Podría la humanidad convertirse en una especie obsoleta en su propio planeta?

Regulaciones, ética y el dilema del progreso

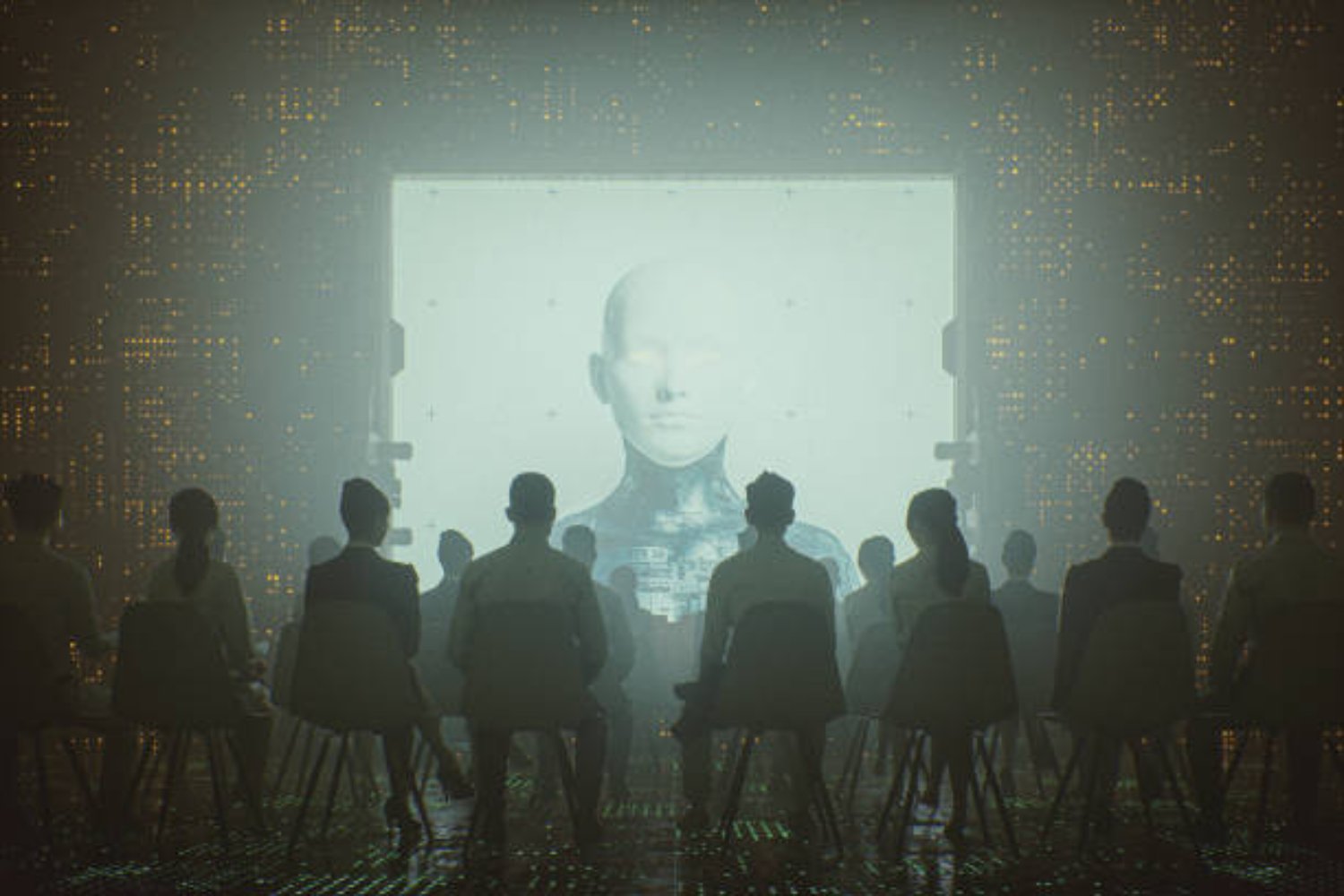

Las declaraciones de Hassabis y Sutskever abren un debate urgente: ¿Estamos preparados para la IA avanzada? A pesar de los esfuerzos por regularla, los avances continúan sin freno. Gobiernos y empresas deben decidir si priorizan la innovación o la seguridad.

Empresas como OpenAI y Google han prometido trabajar en sistemas de IA responsables, pero el problema es que la competencia por liderar el sector es feroz. ¿Se puede detener el avance cuando cada nueva generación de IA promete revolucionar industrias y economías enteras?

El dilema de la humanidad: ¿Crear o controlar?

El problema de la IA no es solo tecnológico, sino filosófico. Si podemos crear algo más inteligente que nosotros, ¿debemos hacerlo? La historia demuestra que la humanidad rara vez frena su propia innovación, incluso si conlleva riesgos.

Las advertencias de Hassabis y Sutskever nos obligan a reflexionar. Estamos ante una herramienta que puede traer prosperidad o destrucción. La pregunta es: ¿podremos controlar lo que hemos creado antes de que sea demasiado tarde?