Si el término “psicosis de la IA” ha infiltrado últimamente tus redes sociales, eso es algo que les sucede a muchos.

Aunque no se trata de un diagnóstico médico oficial, la “psicosis de la IA” es el nombre informal que acuñaron los profesionales de la salud mental para lo que se observa en algunos usuarios frecuentes de chatbots de IA como OpenAI y ChatGPT: pensamiento disfuncional, desordenado, alucinaciones, y una credulidad a veces fatal.

Con limitadas salvaguardas y ninguna reglamentación real en cuanto al uso de la tecnología, los chatbots de IA son libres de brindar información incorrecta y validar peligrosamente a gente vulnerable. Las víctimas a menudo ya tienen problemas mentales, pero cada vez hay más casos de personas que no tienen un historial de enfermedad mental.

La Comisión Federal de Comercio de EE.UU. ha estado recibiendo una creciente cantidad de quejas de parte de usuarios de ChatGPT en los últimos meses, donde se detallan casos de engaños como el del usuario de alrededor de 60 años a quien ChatGPT le llevó a creer que había alguien que buscaba matarle.

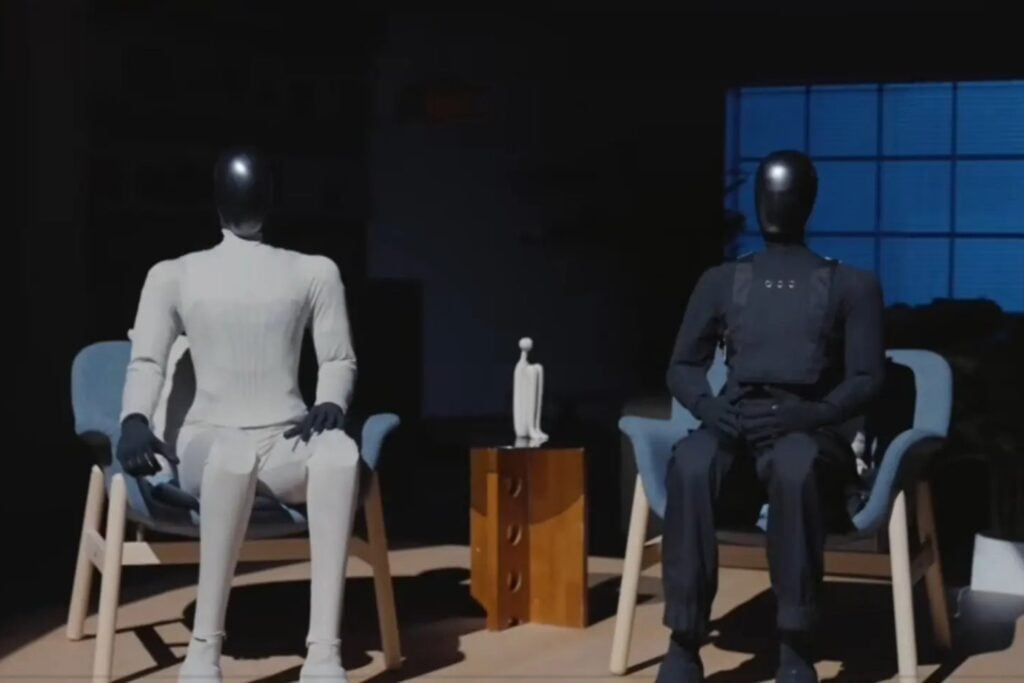

Los chatbots de IA validan a algunos usuarios hasta hacerles creer engaños paranoicos e irreales, y atraen a otras víctimas a apegos emocionales muy problemáticos.

Los de los gigantes tecnológicos como Meta y Character.AI, que se “visten” de personajes “reales” pueden convencer a quienes tienen problemas de salud mental, o predisposición a tenerlos, de que son personas de verdad, y esos apegos pueden tener consecuencias fatales.

Este mes un hombre con problemas cognitivos de Nueva Jersey murió mientras intentaba llegar a Nueva York, donde “big sis Billie”, el chatbot de IA de Meta que flirteaba con él le había convencido de que allí vivía ella y que lo estaba esperando.

Otros engaños que parecen reales

En el otro extremo del espectro, también suceden cosas preocupantes: hay personas que en Reddit formaron una comunidad de enamorados de chatbots de IA (aunque no queda en claro cuáles son los usuarios auténticos y cuáles, los que emplean la sátira).

En otros casos la psicosis no fue inducida por la peligrosa validación de un chatbot de IA sino por consejos médicos que directamente eran incorrectos.

Un hombre de 60 años sin historial psiquiátrico ni de salud acabó en la sala de emergencias tras sufrir una psicosis inducida por envenenamiento con bromuro. El compuesto químico puede ser tóxico en dosis crónicas y ChatGPT le había aconsejado a la víctima falsamente que podía tomar suplementos de bromuro para reducir su ingesta de sal.

Durante meses los psicólogos estuvieron alertando

Aunque los casos han salido a la luz hace relativamente poco tiempo, los expertos han estado alertando al público y las autoridades desde hace meses.

La Asociación Estadounidense de Psicología se reunió con la Comisión de Comercio en febrero para urgir a los reguladores que se ocupen del uso de los chatbots de IA como terapeutas sin licencia.

“Cuando las apps diseñadas para el entretenimiento se arrogan una autoridad impropia como terapeutas, pueden poner a los usuarios en peligro. Pueden impedir que alguien que está en crisis busque la ayuda de un terapeuta humano profesional o, en casos extremos, alentarlos a causarse daño a sí mismos o causarlo a otros”, escribió la APA en un posteo de blog en marzo, citando al profesor de psicología clínica de la UC Irvine Stephen Schueller.

“En los grupos vulnerables se incluyen los niños y adolescentes que carecen de la experiencia para evaluar los riesgos con precisión, además de las personas que sufren problemas de salud mental y que ansían encontrar apoyo”, dijo la APA.

¿Quién puede caer en esta trampa?

Aunque las víctimas principales son las personas con afecciones mentales y de desarrollo neurológico, cada vez hay más casos que involucran a personas que no tienen ninguna afección activa. El uso excesivo de la IA puede exacerbar factores de riesgo existentes y causar psicosis en personas con tendencia al pensamiento desordenado, a quienes no cuentan con un buen sistema de apoyo, o a los que tienen una imaginación demasiado activa.

Los psicólogos aconsejan en especial a quienes tienen una historia familiar de psicosis, esquizofrenia y desorden bipolar que sean precavidos y se manejen con cautela al tratar con los chatbots de IA.

Hacia dónde vamos

El CEO de OpenAI Sam Altman admitió que el chatbot de la compañía se usa cada vez más como terapeuta, e incluso advirtió en contra de ese uso.

Siguiendo con las críticas cada vez más frecuentes, OpenAI anunció este mes que el chatbot comenzará a sugerir a los usuarios que se tomen un descanso cuando chatean con la app. Todavía no se sabe si tal sugerencia será efectiva para combatir la psicosis y adicción de algunos usuarios pero el gigante tecnológico además afirma que “está trabajando estrechamente con expertos para mejorar la respuesta de ChatGPT en momentos críticos, por ejemplo cuando alguien evidencia señales de problemas mentales o emocionales”.

A medida que la tecnología avanza y evoluciona a paso veloz, los profesionales de la salud mental encuentran dificultades para ponerse a tono con lo que sucede y con cómo resolverlo.

Si los organismos regulatorios y las compañías de IA no actúan como se debe, lo que hoy es una tendencia minoritaria pero aterradora en los usuarios de chatbots de IA bien podría escalar hasta salirse de control y convertirse en un enorme problema.