Durante meses, la inteligencia artificial se ha dividido entre dos mundos: los modelos generalistas como GPT y los especializados en razonamiento. Cada uno con sus fortalezas, pero con limitaciones notables. Eso acaba de cambiar. OpenAI acaba de lanzar dos modelos que podrían romper esa barrera para siempre, y las implicancias van mucho más allá de una simple actualización.

Los nuevos modelos que piensan con imágenes

Los modelos O3 y O4-mini de OpenAI inauguran una etapa en la que el razonamiento y las herramientas avanzadas ya no están separados. Hasta ahora, si un usuario quería interpretar una imagen o hacer una investigación en línea, tenía que recurrir a los modelos GPT. Si necesitaba planificación o lógica compleja, debía cambiar a los modelos de razonamiento. Esa brecha se acaba de cerrar.

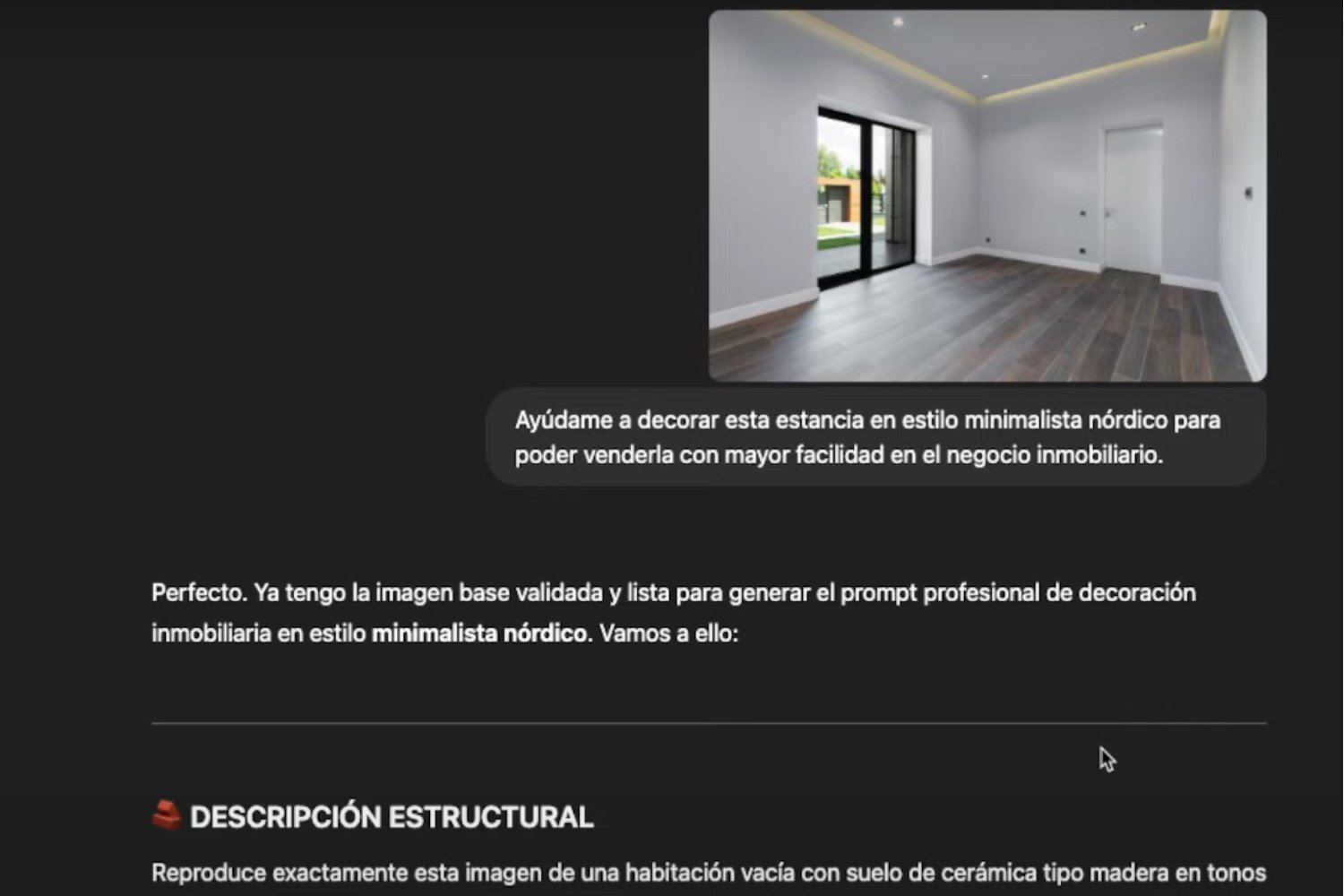

Lo más destacado es que, por primera vez, los modelos razonadores no solo describen lo que ven, sino que procesan visualmente de forma estratégica. O3, por ejemplo, puede decidir si debe rotar una imagen, enfocar un detalle o descartar partes irrelevantes. Este tipo de procesamiento visual ya forma parte de su lógica interna, y lo utiliza como punto de partida para ofrecer respuestas más inteligentes y contextuales.

Además, O3 y O4-mini ya pueden acceder a funciones avanzadas como navegar en la web, generar imágenes, analizar archivos, e incluso operar en modo de voz avanzado. Esto no solo los vuelve más versátiles, sino que los acerca cada vez más a un modelo único capaz de abordar múltiples desafíos sin cambiar de entorno.

Capacidad de razonamiento al servicio de tareas complejas

No se trata únicamente de nuevas herramientas, sino de mejoras profundas en su rendimiento. En pruebas exigentes como SWE-bench (sin ajustes personalizados), O3 logró una puntuación del 69,1%, superando con claridad a su predecesor O1. Incluso comete un 20% menos de errores graves en problemas del mundo real. O4-mini, por su parte, alcanza el 68,1% y destaca por su velocidad, eficiencia y especialización en razonamiento matemático, visual y de codificación.

Ambos modelos han sido diseñados para usuarios que necesitan más que respuestas rápidas: necesitan claridad, planificación y precisión. Son ideales para diseñar flujos de trabajo complejos, resolver problemas científicos o escribir código que realmente funcione.

Un lanzamiento inesperado que cambia la estrategia de OpenAI

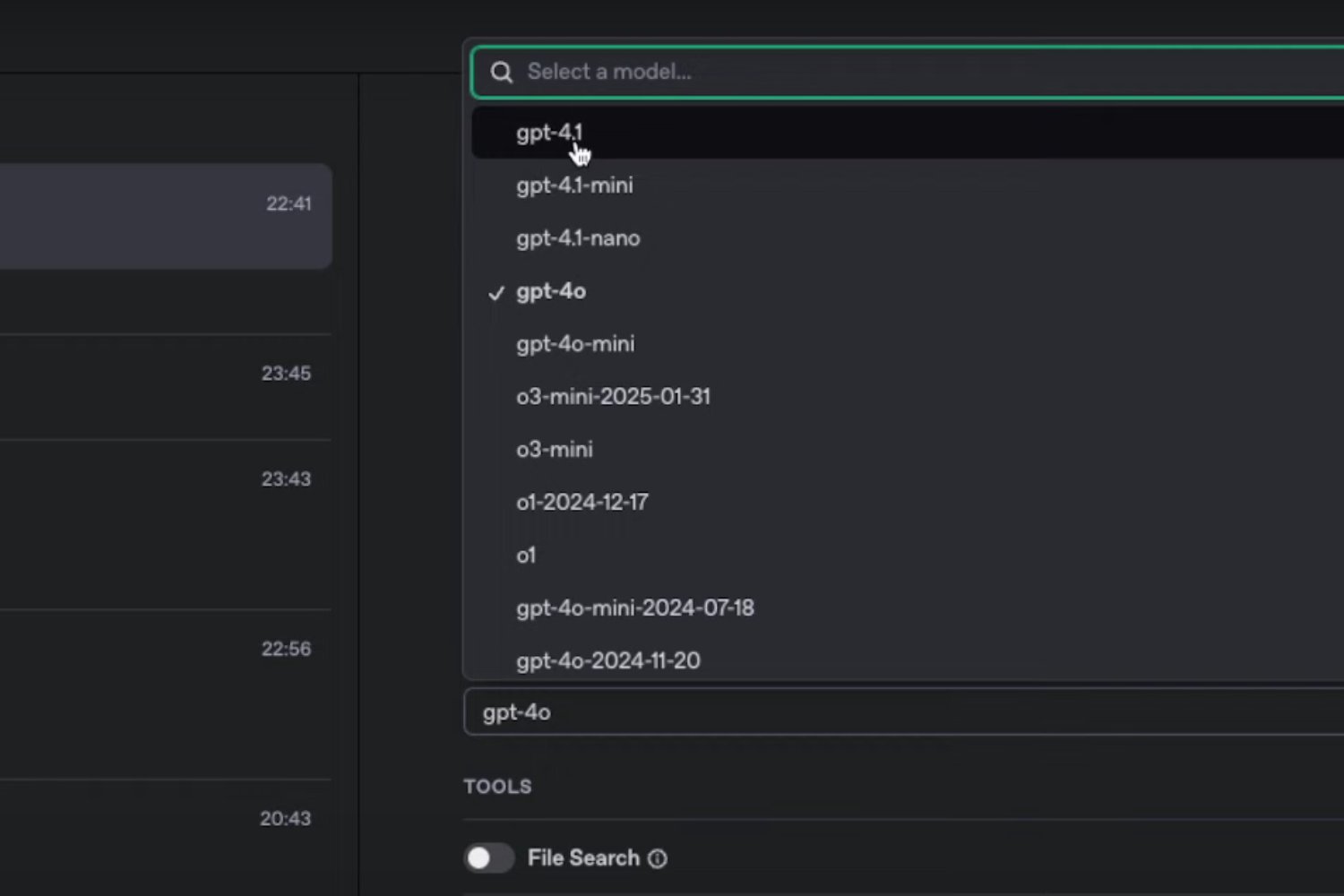

Curiosamente, en febrero, OpenAI había descartado lanzar O3 como modelo independiente. Pero el plan cambió. Sam Altman confirmó recientemente el giro estratégico que hoy se concreta con la aparición de O3 y O4-mini. Y esto apenas comienza: pronto se sumará O3-pro, una versión aún más potente para los usuarios del plan Pro.

Desde hoy, quienes tengan ChatGPT Plus, Pro o Team pueden acceder a los nuevos modelos. Mientras tanto, O1-pro seguirá disponible para quienes prefieran seguir con la versión anterior. Sin embargo, todo indica que el futuro está en estos nuevos modelos híbridos, que no solo entienden lo que decimos… también empiezan a razonar como nunca antes.

Fuente: Xataka.