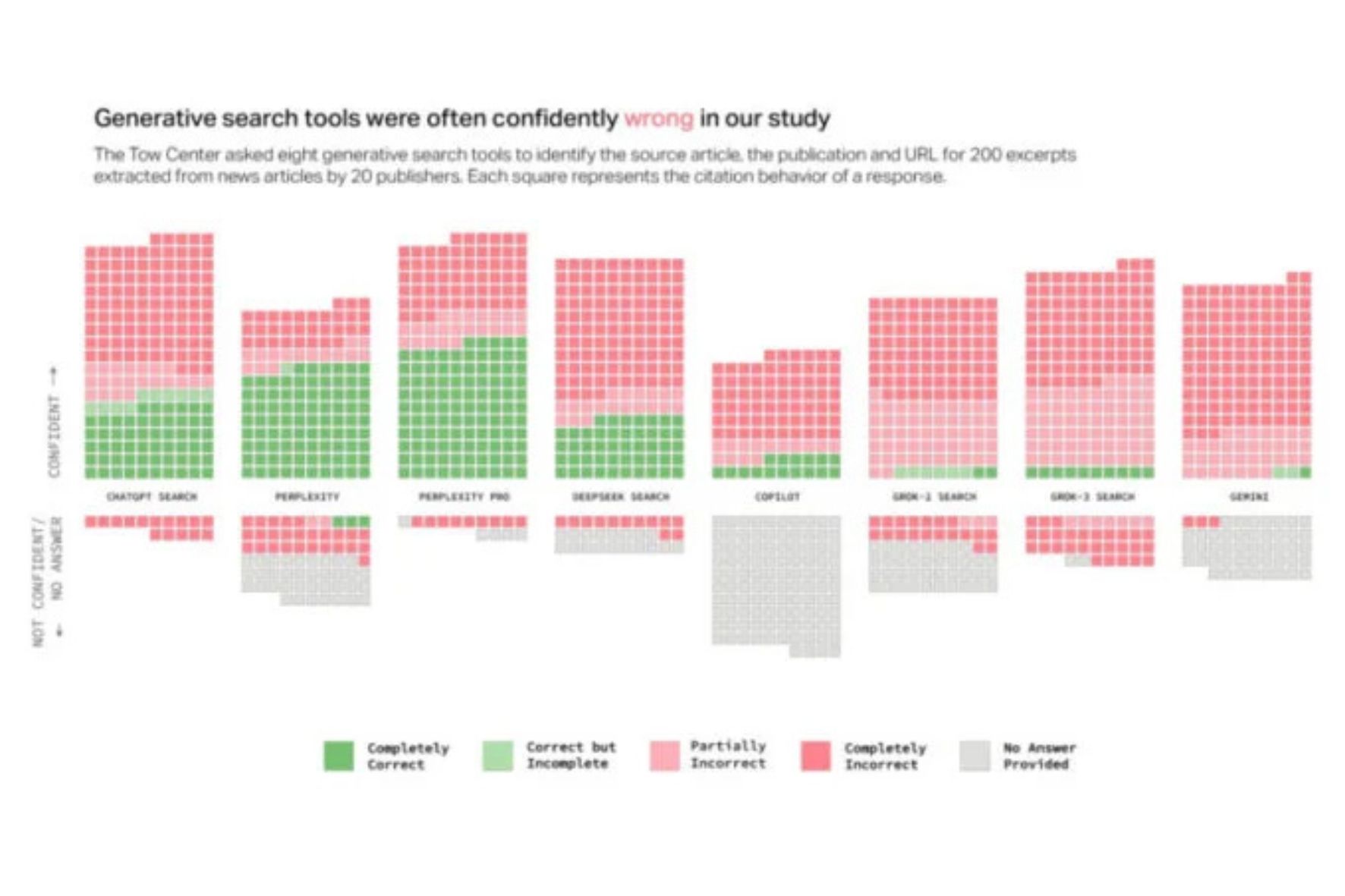

Los motores de búsqueda de la IA son como ese amigo tuyo que afirma ser experto en cantidad de cosas y suele hablar con gran autoridad incluso si no sabe nada del tema. Un nuevo informe de investigación del Columbia Journalism Review (CJR) halló que los modelos de IA de compañías como OpenAI y xAI, muchas veces responden con alguna historia inventada o con detalles erróneos cuando se les pregunta sobre alguna noticia en particular.

Los investigadores ingresaron extractos de noticias reales en varios modelos, y luego les pidieron que identificaran información, como el título, la editorial o la URL. Perplexity contestó con información incorrecta el 37% de las veces en tanto que el resultado extremo fue Grok de xAI, con 97% de las veces. Los errores incluían vínculos a artículos que no llevaban a ninguna parte porque el bot había inventado la URL. En general, se encontró que los modelos de IA escupían información falsa en el 60% de las solicitudes de la prueba.

¡Hacen trampa!

A veces los motores de búsqueda como Perplexity eluden los muros de sitios como National Geographic, incluso si los sitios tienen texto do-not-crawl, que los motores de búsqueda suelen respetar. Perplexity se metió en problemas por eso en el pasado, pero argumentó que la práctica es legítima. Ha intentado ofrecer negocios de ganancias compartidas para aplacar a las editoriales, pero se niega a abandonar la práctica.

Quien haya usado chatbots en los últimos años no tendría por qué sorprenderse. Los chatbots tienen la inclinación a responder, incluso si no están seguros. En chatbots la búsqueda se habilita mediante una técnica llamada generación aumentada, que como lo implica su nombre, barre la red buscando información en tiempo real a medida que produce la respuesta en lugar de depender de una base de datos fija brindada por el fabricante del modelo de IA. Eso podría empeorar el problema de las inexactitud ya que hay países como Rusia que alimentan a los motores de búsqueda con propaganda política.

Una de las cosas más molestas que notaron algunos usuarios de chatbots es que al revisar su texto “razonado” o la cadena de lógica que usan los chatbots para responder, a menudo admiten que están inventando. Han visto que Claude, de Anthropic, inserta datos “para guardar un lugar” cuando se le pide que investigue algo, por ejemplo.

Una voz crítica

Mark Howard, COO de la revista Time, expresó preocupación a CJR sobre la capacidad de las editoriales para controlar de qué manera se ingresa y exhibe su contenido en los modelos de IA. Potencialmente se podría dañar la marca si, por ejemplo, los usuarios se enteran de que los artículos que reciben de The Guardian están mal. Es un problema que afectó recientemente a la BBC, que criticó a Apple por sus resúmenes de notificaciones de Apple Intelligence, con alertas de noticias que estaban mal reescritas. Howard, sin embargo, también culpa a los usuarios. De Ars Technica:

Sin embargo, Howard también se refirió a los usuarios diciendo que es culpa de ellos si no son escépticos acerca de la precisión de las herramientas gratuitas de IA: “Si alguien como consumidor ahora mismo cree que alguno de estos productos gratuitos será 100 por ciento preciso, entonces la culpa es suya”.

En este punto hay que bajar las expectativas. La gente es haragana, y los chatbots responden a las preguntas sonando muy confiados, y eso puede hacer que el usuario sea complaciente. En redes sociales el sentimiento demuestra que la gente no quiere hacer click en links y prefiere obtener una respuesta inmediata de modelos como AI Overviews de Google; CJR dice que uno de cada cuatro estadounidenses utilizan modelos de IA en las búsquedas E incluso antes del lanzamiento de las herramientas de IA generativa, más de la mitad de las búsquedas de Google provenían de información que se obtenía sin siquiera haber hecho click para ingresar a un sitio web. Otros sitios como Wikipedia han demostrado a lo largo de los años que la gente aceptará algo que quizá no tenga tanta autoridad siempre que sea gratuito y se acceda fácilmente.

Que no te sorprenda

Nada de lo que revela CJR debería sorprendernos. Los modelos de lenguaje tienen el gran desafío de entender algo de lo que están diciendo, porque no son más que sistemas glorificados de autocompletar, que intentan crear algo que parezca que es correcto. Improvisan.

Otra cita de Howard que se destaca es que dijo que ve espacio para que los chatbots sean mejores en el futuro. “Hoy el producto es lo peor que podría llegar a ser”, y citó la inversión que ingresa en ese campo. Pero es lo mismo que puede decirse de cualquier tecnología a lo largo de la historia. Sigue siendo irresponsable darle alas y difundir información inventada.