Un nuevo artículo de investigación de OpenAI del jueves dice que una IA sobrehumana está por llegar y la compañía está desarrollando herramientas para garantizar que no lo haga. volverse contra los humanos. El científico jefe de OpenAI, Ilya Sutskever está listado como autor principal de papel, pero no el publicación de blog Eso también sucedió y su papel en la empresa sigue sin estar claro.

“Creemos que la superinteligencia, una IA mucho más inteligente que los humanos, podría desarrollarse en los próximos diez años”, dijo OpenAI en un publicación de blog. “Descubrir cómo alinear los futuros sistemas de IA sobrehumanos para que sean seguros nunca ha sido más importante, y ahora es más fácil que jamás lograr avances empíricos en este problema”.

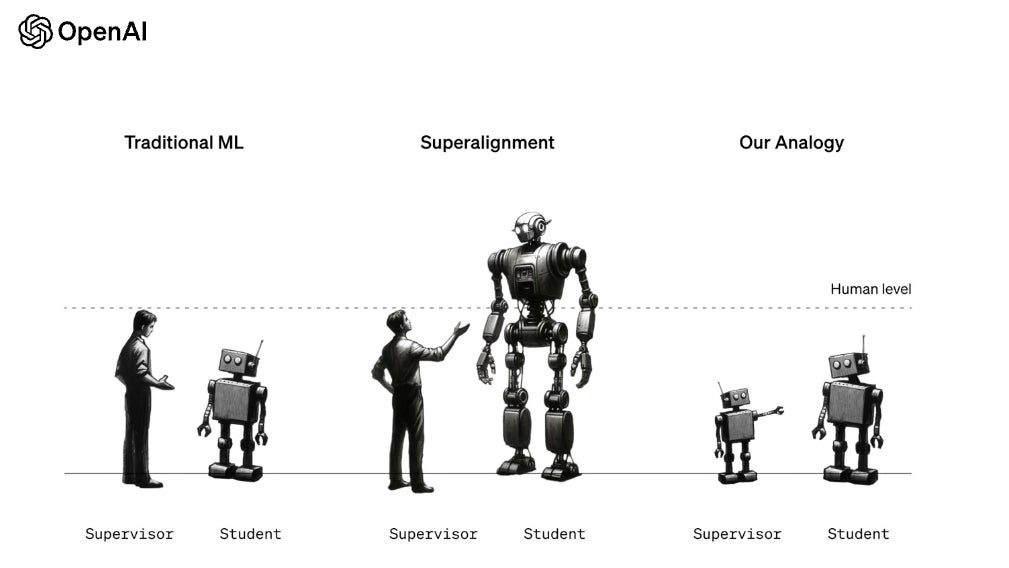

“Generalización de débil a fuerte” es el primer artículo del equipo “Superalignment” de Ilya Sutskever y Jan Leike, creado en julio para garantizar que los sistemas de IA mucho más inteligentes que los humanos sigan las reglas humanas. ¿La solución propuesta? OpenAI necesita diseñar pequeños modelos de IA para enseñar modelos de IA sobrehumanos.

Actualmente, OpenAI utiliza humanos para “alinear” ChatGPT dándole buenos comentarios o comentarios negativos. Así es como OpenAI garantiza que ChatGPT no dará instrucciones a las personas sobre cómo construir napalm en casa u otros resultados peligrosos. Sin embargo, a medida que ChatGPT se vuelve más inteligente, OpenAI reconoce que los humanos no lo harán ser suficiente con entrenar estos modelos, por lo que necesitamos entrenar una IA menos complicada para hacerlo en nuestro nombre.

Esta es la primera señal de vida de Ilya Sutskever en OpenAI desde que Sam Altman anunció que casi todos estaban de regreso en OpenAI cuando salían de Sutskever. estado arriba en el aire. Sutskever, cofundador de OpenAI, fue uno de los miembros de la junta detrás El despido de Altmany es una voz líder en la comunidad de IA para el despliegue responsable de la IA. Ya no lidera la empresa hacia adelante, pero todavía puede tener un rol allí.

El otro líder del equipo de Superalineación de OpenAI, Leike, felicitó a Ilya por “avivar el fuego el jueves, pero felicitó a otros por “avanzar las cosas cada día». Sutskever comenzó este proyecto, pero no fue para terminarlo.

Según se informa, ha sido invisible en la empresa durante las últimas semanas y ha contratado a un abogado, dijeron las fuentes. Información privilegiada sobre negocios. Jan Leike y otros miembros del equipo de Superalineación de OpenAI hicieron declaraciones públicas en este documento histórico, pero Sutskever no ha dicho ni una palabra, solo retuitea.

El estudio encontró que entrenar modelos de IA grandes con modelos de IA más pequeños, lo que ellos llaman “generalización de débil a fuerte”, da como resultado un nivel más alto. de precisión en múltiples circunstancias, en comparación con el entrenamiento humano. Gran parte del estudio utilizó GPT-2 para entrenar a GPT-4. Es importante Tenga en cuenta que OpenAI dice que no está convencido de que esto sea una “solución” para la superalineación, sino simplemente un marco prometedor para entrenar a un superhumano. IA.

“Los modelos sobrehumanos en términos generales serían extraordinariamente poderosos y, si se usan mal o no se alinean con los valores humanos, podrían causar daños catastróficos”, dijeron los investigadores de OpenAI en el estudio, señalando que no ha estado claro cómo estudiar empíricamente este tema. “Creemos que ahora es más fácil progresar más que nunca antes sobre este problema”.

Hubo una especulación significativa de que OpenAI estaba cerca de AGI en noviembre, aunque gran parte no fue concluyente. Este documento confirma que OpenAI está construyendo activamente herramientas para controlar una AGI, pero no no confirma la existencia de un AGI. En cuanto a Ilya Sutskever, su estado permanece en un extraño limbo. OpenAI no ha confirmado su posición en la empresa, pero su equipo simplemente publicó en silencio investigaciones innovadoras mientras retuitea sus anuncios corporativos.