Anthropic acaba de vivir uno de esos accidentes que en la industria de la inteligencia artificial no solo generan incomodidad, sino también una especie de fascinación técnica. La compañía confirmó que expuso por error el código fuente de Claude Code, su asistente de programación, y con ello dejó al descubierto bastante más que la estructura interna de una herramienta popular. Lo que apareció en esas líneas fue, en cierto modo, una hoja de ruta parcial de hacia dónde quiere ir la empresa.

Según reportó VentureBeat, la filtración se produjo a través de un repositorio público que fue detectado por el investigador Chaofan Shou, de Solayer Labs. Lo que encontró no era precisamente menor: una base compuesta por alrededor de 1.900 archivos y más de 512.000 líneas de código, suficiente como para reconstruir buena parte del funcionamiento del sistema y detectar referencias a funciones que todavía no habían sido anunciadas.

Claude Code no sería solo un chatbot para programar

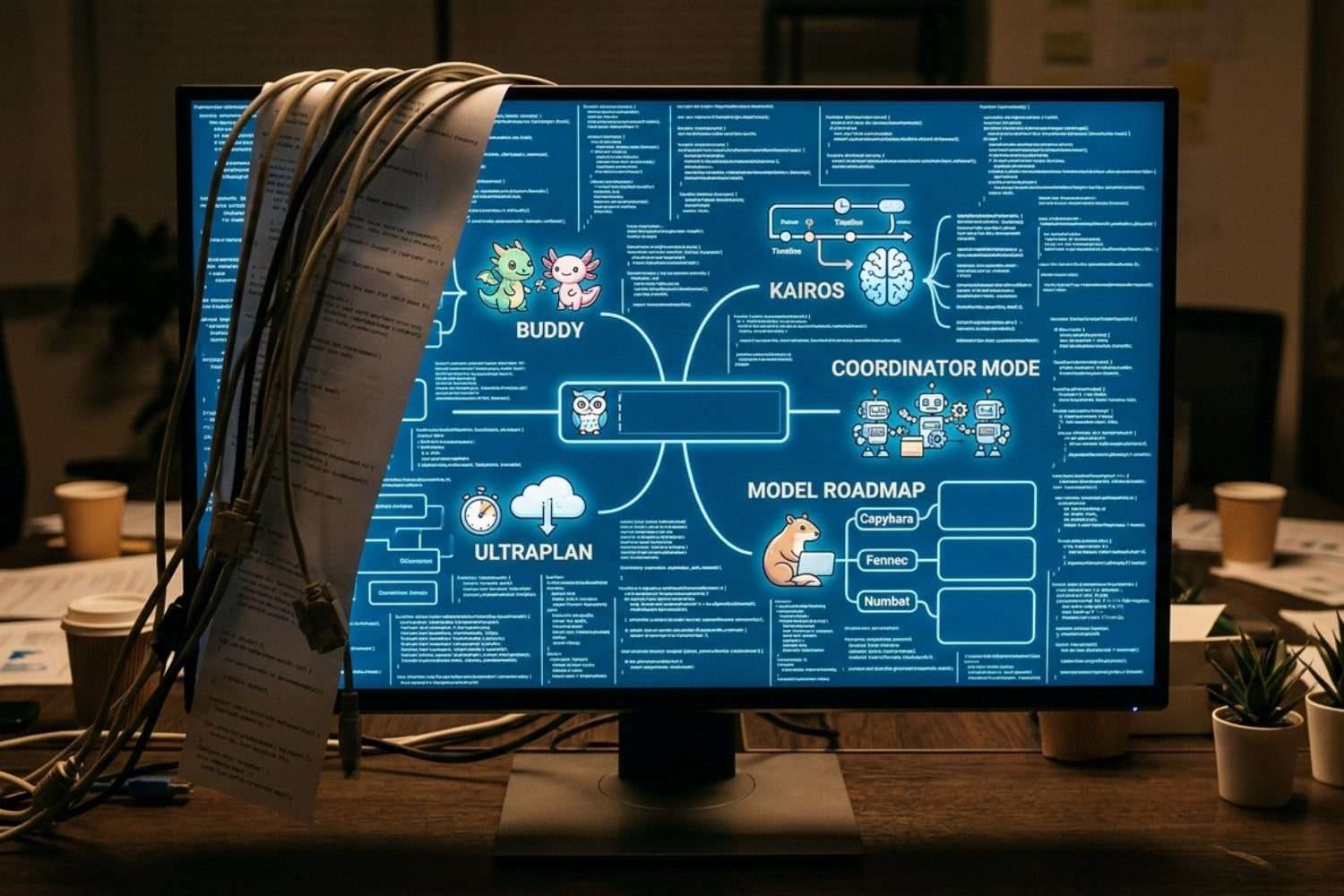

Lo primero que dejó claro la filtración es que Claude Code no opera como una simple interfaz conversacional para pedir snippets o corregir errores. Según los primeros análisis, se trata más bien de una especie de núcleo operativo capaz de coordinar conversaciones, interpretar comandos internos y ejecutar acciones concretas dentro del flujo de trabajo de desarrollo.

Entre las capacidades identificadas aparecen 85 comandos internos y hasta 40 tipos de acciones, incluyendo lectura de archivos, ejecución de instrucciones y edición de código. Eso sugiere una herramienta pensada menos como “chat con IA” y más como un agente técnico con margen de acción real dentro del entorno del programador.

Ese matiz importa. Porque una cosa es tener un asistente que responde preguntas, y otra muy distinta es contar con un sistema que observa, actúa, modifica y toma contexto operativo mientras trabajas.

Lo más llamativo no fue el presente, sino el futuro que apareció en el código

Pero el verdadero interés de esta filtración, sostiene Wired, no estuvo tanto en cómo funciona hoy Claude Code, sino en todo lo que dejó entrever sobre lo que Anthropic prepara a corto plazo.

Uno de los nombres más comentados fue Buddy, una función descrita como una especie de compañero virtual que aparecería junto al cuadro de texto de la interfaz. Según lo encontrado en el código, tendría 18 variantes visuales, entre ellas un pato, un dragón y un ajolote. Puede sonar casi juguetón, pero también apunta a algo más profundo: Anthropic estaría explorando una forma de hacer que la IA no solo sea útil, sino también persistente, visible y emocionalmente más presente dentro de la experiencia de uso.

También apareció Kairos, que probablemente sea la función más interesante de todas. La descripción detectada lo muestra como un asistente permanente que trabaja en segundo plano durante la sesión, registrando decisiones del usuario, detectando errores, identificando cambios en la estructura del código y generando al final una especie de memoria organizada para la próxima interacción.

Si eso llega tal como fue descrito, Kairos no sería simplemente una mejora menor. Sería un paso importante hacia una IA que no solo responde bien, sino que recuerda mejor, entiende procesos largos y construye continuidad real entre sesiones.

— Chaofan Shou (@Fried_rice) March 31, 2026

Más agentes, más contexto y sesiones en la nube

La filtración también incluyó referencias a Ultraplan, una función que habilitaría sesiones de planificación en la nube de hasta 30 minutos, y a un modo coordinador en el que una instancia de Claude podría gestionar múltiples agentes simultáneamente.

Esto encaja con una tendencia cada vez más visible en la industria: el salto desde los modelos que responden una tarea a los sistemas que orquestan varias subtareas al mismo tiempo, dividen trabajo, conservan memoria y colaboran como si fueran pequeños equipos especializados.

Dicho de otro modo: el futuro de estos asistentes ya no pasa solo por escribir mejor código, sino por organizar mejor el trabajo intelectual alrededor del código.

También aparecieron nombres de modelos todavía no anunciados

Como si eso fuera poco, entre las líneas del repositorio también se detectaron nombres clave vinculados a modelos de IA en desarrollo. Entre ellos aparecen Capybara, que estaría asociado a una variante de Claude 4.6; Fennec, vinculado a una nueva versión de Opus 4.6; y Numbat, un modelo aún no identificado que seguiría en fase de pruebas.

No significa necesariamente que todos esos nombres se conviertan en productos públicos, pero sí ofrece una imagen bastante clara de algo que la industria ya sospechaba: Anthropic está expandiendo su ecosistema mucho más allá del chatbot clásico.

Anthropic dice que fue un error humano, pero el episodio deja una señal más profunda

La empresa explicó que el incidente se originó por un error humano durante el empaquetado de la versión npm de Claude Code y aseguró que no se expusieron datos ni credenciales confidenciales de clientes. También indicó que ya trabaja en medidas para evitar que vuelva a ocurrir.

Aun así, el episodio deja una conclusión incómoda. En un momento en el que las empresas de IA están construyendo herramientas cada vez más complejas, persistentes y con mayor autonomía, la madurez operativa empieza a importar tanto como la capacidad técnica.

Porque aquí no se filtró solo código. Se filtró una visión. Y a veces, una visión accidental dice más de una compañía que cualquier keynote cuidadosamente ensayada.