Cualquiera que haya pasado un momento observando la charla política estadounidense en los últimos meses probablemente se haya encontrado con la siguiente predicción: 2024 producirá las primeras elecciones deepfake del mundo. Rápidamente evolucionando Generadores de vídeo y audio con IA impulsados por modelos en grandes idiomas ya han sido utilizados por ambos Donald Trump y Ron DeSantis campañas presidenciales para difamarse entre otros y falsificaciones del actual presidente Joe Biden parecen proliferar de forma regular. Los legisladores nerviosos, posiblemente preocupados de que sus rostros pronto terminen absorbidos por el atolladero generado por la IA, se han apresurado a proponer más de una docena de proyectos de ley que intentan controlar los deepfakes a nivel estatal y federal.

Pero los legisladores que se muerden las uñas llegan tarde a la fiesta. Los deepfakes dirigidos a políticos pueden parecer nuevos, pero Pornografía generada por IA, que todavía constituye la abrumadora mayoría de deepfakes no consensuados, ha atormentado a miles de mujeres durante más de media década, sus historias a menudo enterrados bajo la superficie de las principales preocupaciones. Un grupo de víctimas deepfake están intentando levantar ese velo contando su trauma y el pasos que han tomado para luchar contra sus agresores, en un nuevo e impactante documental llamado Otro cuerpo.

Una de esas mujeres objetivo, una popular streamer de ASMR con 280.000 seguidores en Twitch, nombrada gibi, habló con Gizmodo sobre su decisión de reconocer públicamente los deepfakes sexuales que se hicieron de ella. Ella espera que su plataforma pueda ayudar a destacar sobre el tema que con demasiada frecuencia se pasa por alto.

“Creo que pasamos la mayor parte de nuestro tiempo convenciéndonos a nosotros mismos de que no es gran cosa y de que hay cosas peores en el mundo. ”, dijo Gibi en una entrevista con Gizmodo. “Así es como me las arreglo con mi día, solo que no puedes deja que te moleste, para convencerte de que no es tan malo”.

“Escuchar de otras personas que es “Eso es malo es una mezcla de emociones”, añadió. “Es un poco aliviador y también un poco aterrador”.

Gibi fue una de varias mujeres en la película que cuentan sus experiencias después de encontrar deepfakes de sí mismas. El documental, dirigido por los cineastas Sophie Compton y Reuben Hamlyn, sigue en gran medida la vida de una estudiante de ingeniería llamada Taylor que descubrió pornografía deepfake de ella misma que circulaba en línea. Es el nombre real del estudiante. De hecho, todas las apariciones de Taylor y otra víctima deepfake presentadas en el documental son en realidad videos deepfake creados. para ocultar sus verdaderas identidades.

El estudiante de 22 años descubre el deepfake después de recibir un escalofriante mensaje de Facebook de un amigo que le dice: “Lo siento mucho, pero Creo que necesitas ver esto”. A continuación aparece un enlace de PornHub.

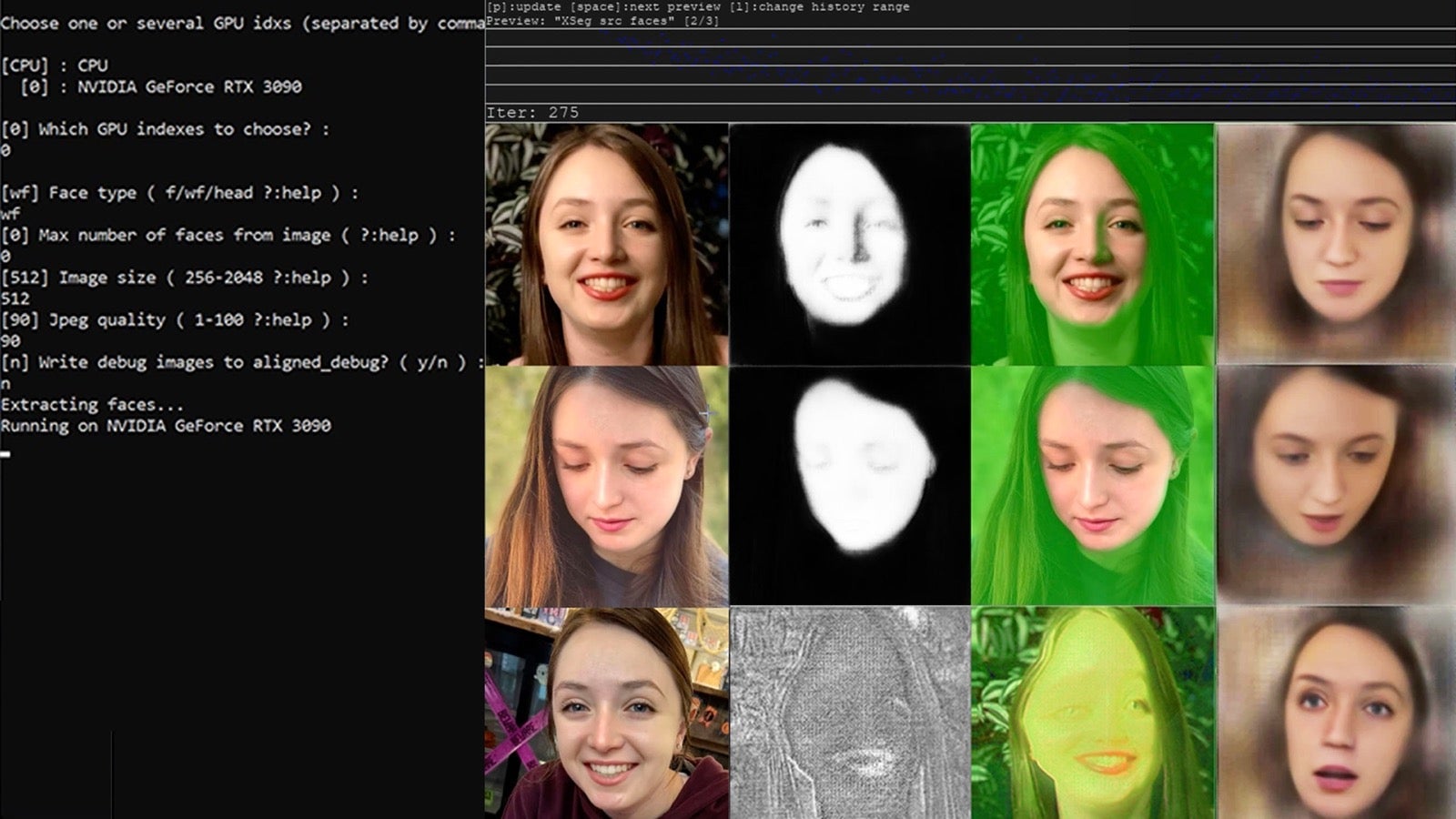

Taylor no cree el mensaje al principio y se pregunta si la cuenta de su amiga fue pirateada. Finalmente decide hacer clic en el enlace y Se presenta con su cara envuelta en pornografía de tapa dura mirándola fijamente. Taylor más tarde se entera de que alguien sacó imágenes de su cara de sus cuentas de redes sociales y las pasó a través de un modelo de inteligencia artificial para hacerla aparecer en seis videos de sexo deepfaked. Para empeorar las cosas, La culpable detrás de los videos los publicó en un perfil de PornHub haciéndose pasar por su nombre y con su verdadera universidad y ciudad natal en la lista.

La película, a veces devastadora y horrorosa, deja al descubierto el trauma y la impotencia que las víctimas de los deepfakes se ven obligadas a soportar cuando se les presentan representaciones sexualizadas. de sí mismos. Si bien la mayoría de las conversaciones y los medios que muestran deepfakes se centran en celebridades o individuos de alto perfil ante el público, Otro cuerpo ilustra una realidad preocupante: la tecnología deepfake impulsada por modelos en lenguajes grandes cada vez más poderosos y de fácil acceso significa que la cara de todos está en juego, independientemente de su fama.

En lugar de concluir con una nota sombría, la película pasa la mayor parte de su tiempo siguiendo a Taylor mientras desvela pistas sobre sus deepfakes. Finalmente, se entera de que otra niña en su escuela fue blanco de deepfakes similares sin su consentimiento. Luego, los dos se sumergen profundamente en 4Chan y otros focos de depravación deepfake para descubrir cualquier pista que puedan desenmascarar a su torturador. Es durante ese descenso a las profundidades del deepfake bajo tierra donde Taylor tropieza con imágenes falsas de Gibi, el streamer de Twitch.

El streamer de Twitch habla

Gibi, hablando con Gizmodo, dijo que ha estado recibiendo tantos videos deepfake en este momento que ni siquiera puede recordar cuando vio el primero.

“Todo simplemente se fusiona”, dijo.

Como streamer, Gibi se ha enfrentado durante mucho tiempo a una serie de acosos que comienzan con mensajes de texto sexualizados y fotos de penes más que ocasionales. Deepfakes, ella dijo, se añadieron gradualmente a la mezcla a medida que la tecnología evolucionó.

Al principio, dice, las falsificaciones no eran tan sofisticadas, pero la calidad evolucionó rápidamente y “empezaron a parecer cada vez más reales”. .”

Pero incluso los videos obviamente falsos todavía logran engañar a algunos. Gibi dice que se sorprendió cuando escuchó que personas que conocía se enamoraban del Imágenes tempranas de ella, crudas y reunidas apresuradamente. En algunos casos, la streamer dice que ha oído hablar de anunciantes que cortaron vínculos con otros creadores. completamente porque creían que estaban participando en pornografía cuando no era así.

“Ella estaba como, ‘Ese no soy yo’”, dijo Gibi sobre su amiga que perdió el apoyo de los anunciantes debido a un deepfake.

Gibi dice que sus interacciones con Taylor la inspiraron parcialmente a lanzar un video de YouTube titulado “Hablando contra los deep fakes donde se abrió sobre sus experiencias en la recepción de medios manipulados generados por IA. El video, publicado el año pasado, ha atraído desde entonces a casi medio millón de personas. vistas.

“Hablar de ello simplemente significaba que habría más ojos puestos en ello y le daríamos una audiencia más grande”, dijo Gibi. . “Sabía que mi fuerte estaba más en la esfera pública, publicando en línea y hablando de temas difíciles y siendo sincero, mucho trabajo. .”

Cuando Gibi decidió abrirse sobre el tema, dice que inicialmente evitó leer los comentarios, sin saber cómo reaccionaría la gente. Afortunadamente, Las respuestas fueron abrumadoramente positivas. Ahora espera que su participación en el documental pueda atraer aún más miradas hacia posibles soluciones legislativas para Prevenir o castigar los deepfakes sexuales, un tema que ha pasado a un segundo plano frente a la legislación política sobre deepfakes en los últimos meses. Hablando con Gizmodo, Gibi dijo ella se mostró optimista sobre el renovado interés del público en los deepfakes, pero expresó cierta molestia porque el foco de atención solo llegó después de que el problema comenzó a impactar. áreas más dominadas por hombres.

“Los hombres son a la vez los delincuentes y los consumidores y también las personas a las que sentimos que tenemos que apelar para cambiar cualquier cosa”. Gibi dijo. “Así que eso es frustrante”.

Esas frustraciones tuvieron eco en el fundador de EndTAB, Adam Dodge, quien también hace varias apariciones en Otro cuerpo. Un abogado que trabajó en violencia de género durante 15 años, Dodge dijo que fundó EndTab para empoderar a los proveedores de servicios a las víctimas y educar líderes sobre las amenazas que plantea la tecnología utilizada para llevar a cabo el acoso. Taylor, la estudiante universitaria que aparece en la película, se acercó a Esquiva en busca de consejo después de descubrir sus propios deepfakes.

Hablando con Gizmodo, Dodge dijo que es importante reconocer que el acoso en línea no es realmente nuevo. La IA y otras tecnologías emergentes simplemente están amplificando un problema existente.

“La gente ha estado usando imágenes desnudas de las víctimas para acosarlas o ejercer poder y controlarlas o humillarlas durante mucho tiempo”, Dodge dijo. “Esta es simplemente una nueva forma en que la gente puede hacerlo”.

Los deepfakes han alterado la ecuación, señala Dodge, de una manera crucial. Las víctimas ya no necesitan tener imágenes íntimas de sí mismas en línea para estar Dirigido. Simplemente tener fotos disponibles públicamente en Instagram o en el sitio web de una universidad es suficiente.

“Ahora todos somos víctimas potenciales porque todo lo que necesitan es una foto de nuestra cara”, dijo Dodge.

A pesar de que su organización está destinada principalmente a fines de capacitación, Dodge dice que las víctimas lo buscarían en busca de ayuda porque era uno de Las pocas personas que intentan crear conciencia sobre los daños desde el principio. Así fue como conoció a Taylor.

Hablando con Gizmodo, Dodge expresó frustraciones similares con el alcance de algunas leyes emergentes sobre deepfakes. A pesar de que la abrumadora mayoría de deepfakes se publican en línea involucran pornografía no consensual de mujeres, Dodge estima que alrededor de la mitad de los proyectos de ley que ha visto se centran en la integridad electoral

“Creo que eso se debe a que la violencia contra las mujeres es un tema al que nunca se le presta la debida atención, se subvierte consistentemente en favor de otras narrativas, y los legisladores y políticos se han centrado en la desinformación profundamente falsa que apuntaría a la esfera política porque es un problema que los afecta personalmente ”, dijo. “Realmente, de lo que estamos hablando es de una cuestión de privilegios”.

Los deepfakes están consumiendo Internet

Los deepfakes sexuales están proliferando a un ritmo asombroso. Un investigador independiente hablando con Wired Esta semana se estima que se han subido unos 244,625 videos a los 35 principales sitios web de pornografía deepfake en los últimos siete años. Casi la mitad ( 113.000) de esos vídeos se subieron durante los primeros nueve meses de este año. Para aclarar el punto, el investigador estima que habrá más vídeos deepfaked se subirá a finales de 2023 que todos los demás años combinados. Eso ni siquiera incluye otros deepfakes que puedan existir en redes sociales o en las colecciones personales de un creador.

“Ha habido un crecimiento significativo en la disponibilidad de herramientas de inteligencia artificial para crear imágenes pornográficas no consentidas deepfake y un aumento en la demanda de estas tipo de contenido en plataformas de pornografía y redes en línea ilícitas”, dijo Asher Flynn, profesor asociado de la Universidad de Monash, en una entrevista con Wired. Es probable que aumente con nuevas herramientas de IA generativa”.

Por desalentadores que pueda parecer todo esto, los legisladores están trabajando activamente para encontrar posibles soluciones. Alrededor de media docena de estados ya han legislación aprobada criminalizar la creación y el intercambio de deepfakes sexualizados sin el consentimiento de un individuo. En Nueva York, recientemente se aprobó una ley que hace ilegal su difusión o circular imágenes sexualmente explícitas de alguien generadas por inteligencia artificial entra en vigor en diciembre. Los infractores de la ley podrían enfrentar hasta un año de prisión.

“Mi proyecto de ley envía un fuerte mensaje de que Nueva York no tolerará esta forma de abuso”, dijo la senadora estatal Michelle Hinchey, autora del proyecto de ley. recientemente dichoHudson Valley One, “Las víctimas tendrán legítimamente su día en la corte”.

En otros lugares, los legisladores a nivel federal están presionando a las empresas de IA para crear marcas de agua digitales que revelarán claramente al público cuando los medios han sido alterados usando sus programas. Algunas empresas importantes involucradas en La carrera de la IA, como OpenAI, Microsoft y Google, tiene voluntariamente acordado trabajar para un sistema claro de marcas de agua. Aún , Dodge dice que los esfuerzos de detección y las marcas de agua sólo abordan hasta cierto punto. Deepfakes pornográficos, señala, son devastadoramente dañinos y crean un trauma duradero incluso cuando todo el mundo sabe que son falsos.

Incluso con los deepfakes no consensuales a punto de dispararse en el futuro cercano, Dodge sigue siendo sorprendente y tranquilizadoramente optimista. Los legisladores, dijo, parecen estar dispuestos a aprender de sus errores pasados.

“Todavía creo que estamos muy temprano y estamos viendo cómo se legisla. Estamos viendo que la gente habla de ello”, dijo Dodge. “A diferencia de que las redes sociales existen desde hace una década y [los legisladores] realmente no hacen lo suficiente para proteger a las personas del acoso y el abuso en su plataforma, esta es un área donde la gente está bastante interesada en abordarla en todas las plataformas y si la aplicación de la ley legislativa o la tecnología sociedad en general”.