La tecnología tiene una costumbre implacable: convertir lo extraordinario en cotidiano. Lo que ayer parecía reservado a gobiernos, laboratorios o grandes corporaciones, mañana puede terminar en una tienda online o dentro del despacho de cualquier entusiasta.

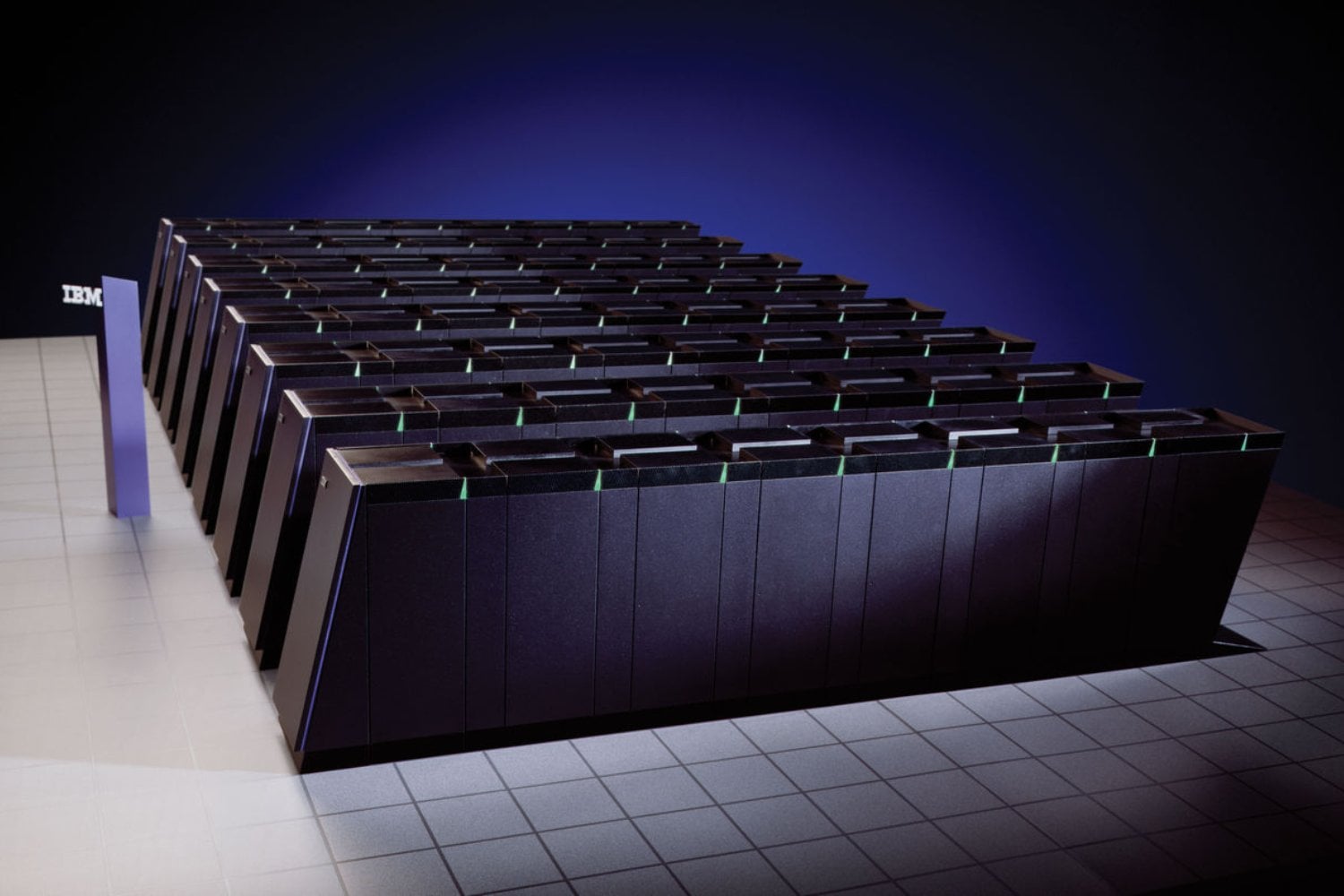

Eso es exactamente lo que refleja la historia de BlueGene/L, la supercomputadora con la que IBM dominó el mundo del rendimiento en 2004.

Cuando IBM tocó el techo de la computación

BlueGene/L no era una máquina cualquiera. Fue diseñada como una demostración de fuerza tecnológica y también como una herramienta científica de primer nivel. El sistema integraba 32.768 procesadores distribuidos en miles de nodos, además de cerca de 16 TB de almacenamiento, una cifra impresionante para la época. Su potencia la llevó al primer puesto del ranking TOP500, la lista que clasifica a las supercomputadoras más rápidas del planeta.

En aquel momento, hablar de más de 70 TFLOPS era hablar de frontera tecnológica. Muy pocas instituciones podían siquiera soñar con algo parecido. Y desde luego, nadie imaginaba que una parte de ese poder acabaría años después en un PC doméstico.

La GPU que cambió la escala de todo

Hoy una tarjeta gráfica como la NVIDIA RTX 4090 puede superar esos números en ciertos escenarios de cálculo paralelo y procesamiento gráfico. Según configuraciones y cargas de trabajo, esta GPU ronda más de 80 TFLOPS e incluso puede acercarse a cifras superiores en operaciones específicas. Todo ello dentro de un componente que cabe en una caja de ordenador de sobremesa.

La comparación no significa que una RTX sustituya a una supercomputadora completa en todos los usos. BlueGene/L estaba optimizada para simulaciones científicas complejas, redes de interconexión avanzadas y cargas distribuidas masivas. Pero el símbolo es contundente: una sola pieza de hardware de consumo ya iguala o supera parte del rendimiento bruto que hace veinte años exigía instalaciones gigantescas.

Cómo ocurrió algo así

La respuesta está en varias revoluciones simultáneas. La miniaturización permitió colocar más transistores en menos espacio. Las arquitecturas paralelas evolucionaron enormemente. La eficiencia energética mejoró y la fabricación avanzó generación tras generación.

Además, las GPU dejaron de ser simples aceleradoras para videojuegos y se convirtieron en motores de inteligencia artificial, renderizado profesional, simulación y ciencia de datos. Es decir, no crecieron solo en potencia. Cambiaron de categoría.

No solo pasó con las computadoras

La historia se repite en otros terrenos. Los disquetes dieron paso a memorias USB diminutas con miles de veces más capacidad. Los CD quedaron atrás frente a SSD ultrarrápidos. Cámaras profesionales enteras fueron parcialmente absorbidas por teléfonos móviles.

La industria tecnológica lleva décadas comprimiendo el tamaño mientras expande el rendimiento.

El futuro también encoge

Paradójicamente, algunas GPU modernas vuelven a plantear un problema físico: son tan potentes y voluminosas que no caben en todos los gabinetes. Más de un usuario lo descubre tarde, después de meses planeando su PC ideal. Aun así, el mensaje de fondo sigue siendo fascinante.

En 2004, para tocar la cima del rendimiento hacían falta salas enteras. Hoy, parte de esa cima se instala con cuatro tornillos y una fuente potente.