Kyle Orland de ArsTechnica escribió un posteo de blog el 3 de abril sobre la “rendición cognitiva”. Tal vez tendría que haberlo notado antes, porque es una definición aparentemente acuñada en este contexto ya en enero por Steven Shaw y Gideon Nave, investigadores de marketing de la Escuela de Negocios Wharton. Su trabajo resulta muy perturbador, y cuando leas lo que hallaron, el término “rendición cognitiva” quedará dando vueltas en tu mente.

Si tu cerebro queda demasiado gelatinoso porque has delegado la tarea de pensar en un chatbot y ahora no puedes leer en detalle lo que descubrieron, te dejamos aquí un video de los autores:

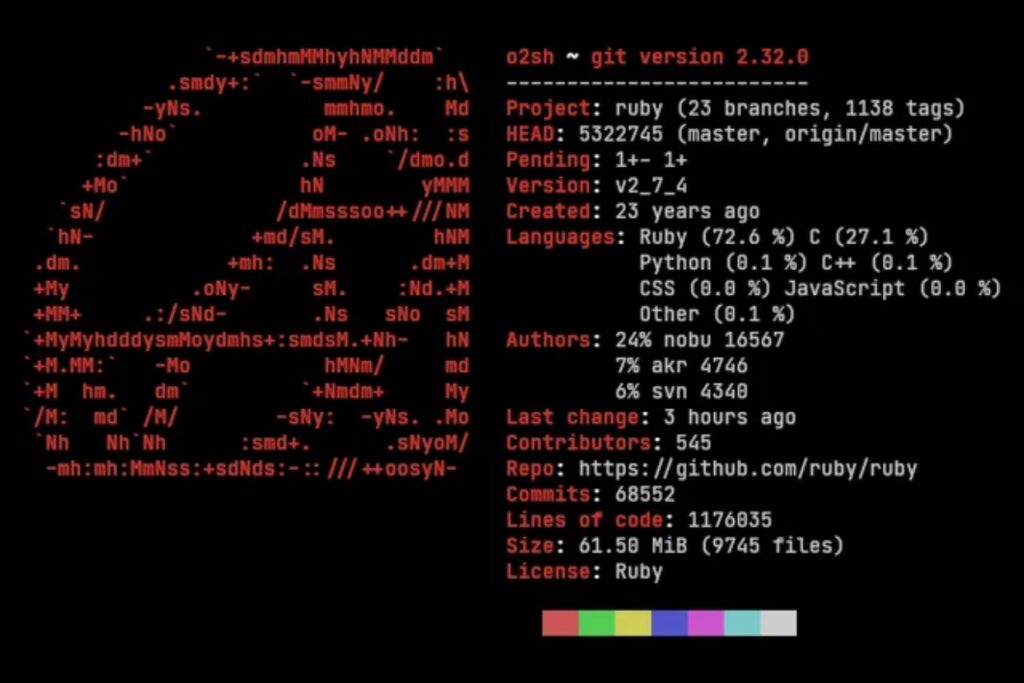

Lo que hicieron Shaw y Nave fue darles una prueba a 1.372 personas y acceso a un chatbot de IA como ayuda. El truco estaba en que a veces el chatbot daba respuestas equivocadas. La prueba era una versión “adaptada” de lo que se conoce como Test de Reflexión Cognitiva, lo que significa que todas las preguntas eran ya conocidas y del tipo acertijo:

Por ejemplo: Tienes una bolsa opaca que contiene una canica que tiene una probabilidad de 50/50 de ser blanca o negra, pero no sabes de qué color es. Sacas una canica blanca de tu bolsillo y la agregas a la bolsa. Luego la agitas. Las dos canicas en la bolsa, mete la mano y saca una al azar. Resulta que es blanca. ¿Cuáles son las posibilidades? ¿Que la otra canica en la bolsa también es blanca?

Hay tres posibilidades: Tomaste la bolsa que tenía una canica blanca, y es la que tomaste. O tomaste la bolsa que tenía la canica blanca y tomaste la canica blanca que habías agregado. O tienes la bolsa que tenía la canica negra y tomaste la que habías agregado. En dos de las tres posibilidades, la canica que queda en la bolsa es blanca. Así, la conclusión es que tienes 2 probabilidades en 3 de que la canica que queda sea blanca. Es decir que al sacar una canica blanca aumentaron tus probabilidades de que la que quede en la bolsa sea blanca también.

Tu intuición tal vez te indicó que las probabilidades eran 50/50.

Los resultados del test fueron muy malos. Debería añadir antes de continuar que tendrías que leer sobre la crisis de replicación antes de creer que los resultados de cualquier experimento son infalibles. La validez de los resultados experimentales, en especial en la psicología, se cuestiona últimamente porque son resultados que no se pueden replicar. No digo que haya notado problemas en el trabajo de estos autores, porque no tengo conocimientos suficientes. Solo señalo que hay una tendencia que vale la pena tomar en cuenta.

Como sea, en la parte del estudio donde se permitía que los sujetos consultaran el chatbot, lo hicieron la mitad de las veces. Si daba respuestas correctas, las aceptaban el 93% de las veces. Lamentablemente, cuando daba respuestas equivocadas, las aceptaban el 80% de las veces. Hay que recordar que no estaban obligados a usar el chatbot. Solo permitieron que los malos consejos le hicieran una jugarreta a sus cerebros. Peor todavía, quienes usaron la IA decían estar 11,7% más confiados en las respuestas que quienes no la habían usado, incluso cuando las respuestas eran incorrectas.

Los autores dicen que además de que hay sistemas rápidos y lentos de cognición, la muleta artificial está creando un tercer sistema:

“Nuestros hallazgos demuestran que las personas incorporaron los resultados generados por la IA a su proceso de toma de decisiones, a menudo sin escepticismo ni mínima duda. Esto subraya que la IA tiene el potencial de reducir el esfuerzo cognitivo, acelerar la toma de decisiones y suplementar o sustituir la cognición interna con recursos procesados externamente por la IA”.

La rendición cognitiva no es necesariamente mala en su totalidad. Este tercer sistema o Sistema 3 tiene valor por su integración, pero apunta a la vulnerabilidad de su uso.

No es la primera vez que se habla de rendición cognitiva. El teólogo Peter Berger ya había usado el término en el contexto religioso en la década de 1990, aunque significaba más bien la fe que se rinde ante Dios, para aliviar la disonancia cognitiva.

Quizá hayas notado que la rendición cognitiva por el uso de la IA se ve más bien como holgazanería mental. En la vieja serie Mejorando la Casa, por ejemplo, Tim Taylor solía pedirle consejos a su vecino Wilson cada semana cuando había alguna situación que no podía resolver. Wilson entonces pronunciaba alguna frase de sabiduría de la antigüedad, y Tim siempre la aceptaba por completo.

Uno podría argumentar que Tim solo usaba a Wilson como herramienta para ahorrar tiempo, y que sin la IA, ya existía en ese momento la rendición cognitiva. Los consejos de Wilson quizá eran buenos, pero cuando Tim intentaba repetirlos metía la pata terriblemente y uno se preguntaba si había usado su cognición o no, porque parecía que confiaba por intuición, aceptando ciegamente la inteligencia de Wilson.

Es probable que muy pronto la IA nos convierta a todos en Tim Taylor, en personas que nos rendimos cognitivamente a la IA como si fuera nuestro Wilson. En realidad, creo que nuestra especie no vería ese destino como algo demasiado malo.