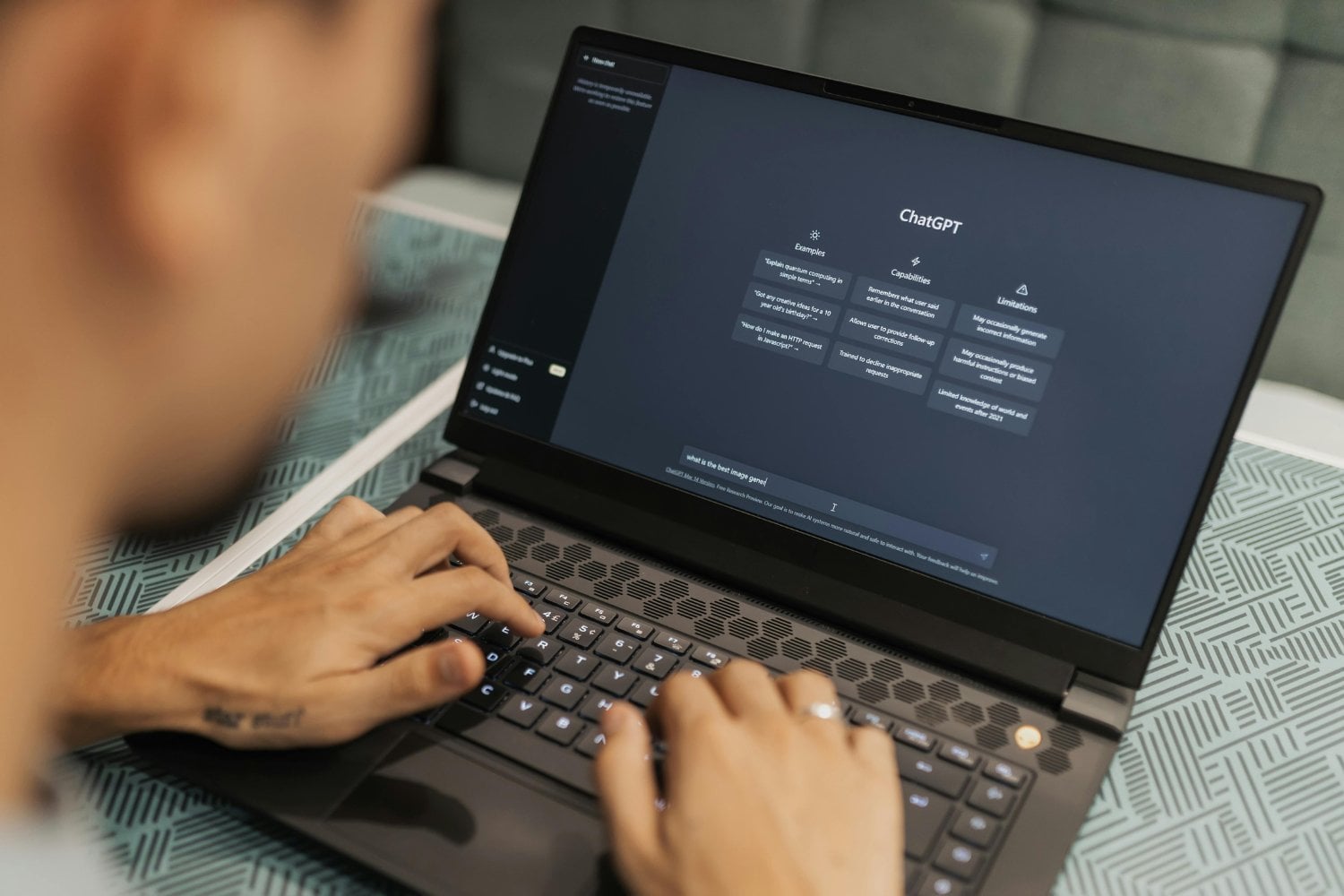

El uso de la inteligencia artificial como herramienta cotidiana ya es una realidad. Desde escribir textos hasta resolver dudas complejas, millones de personas recurren cada día a sistemas como ChatGPT. Pero lo que en principio parece práctico y útil, puede convertirse en una auténtica bomba de relojería cuando se trata de la salud. El nuevo fenómeno viral deja claro que el riesgo va mucho más allá de lo que imaginábamos.

La moda inquietante del “hazlo tú mismo” estético

Cada vez más usuarios, especialmente en comunidades como la de Reddit llamada DIYaesthetics, comparten experiencias y consejos sobre cómo inyectarse bótox o ácido hialurónico en casa, sin formación médica ni supervisión. Lo más alarmante es que muchos de ellos reconocen haber acudido a ChatGPT para saber cómo hacerlo: qué aguja usar, a qué profundidad inyectar o qué zona del rostro es la más adecuada.

En uno de los casos más comentados, una usuaria preguntó a la IA si debía usar guantes durante el procedimiento. Las respuestas no solo omitieron alertarla sobre los peligros, sino que otros usuarios validaron la consulta sin mostrar preocupación. En otro hilo, tras sufrir una deformación en la cara, otra persona volvió a preguntar a la IA qué podría haber pasado. La respuesta, aunque aparentemente tranquilizadora, carecía del rigor clínico necesario.

IA como médico improvisado: una tendencia creciente

El fenómeno no se limita al mundo estético. Muchas personas han empezado a usar herramientas de IA como si fuesen médicos de cabecera, especialmente en temas de salud mental o para obtener diagnósticos rápidos y gratuitos. Algunos estudios incluso aseguran que ChatGPT ofrece respuestas más claras que los servicios de atención médica online, aunque otros destacan que más del 30% de sus respuestas médicas contienen errores.

Este tipo de comportamiento refleja una mezcla de desesperación, desconocimiento y confianza excesiva en la tecnología. La combinación puede resultar muy peligrosa si no se establece un marco de uso responsable.

IA en la medicina: potencial sí, pero con límites

No todo es negativo. La inteligencia artificial se ha convertido en una aliada poderosa en el ámbito sanitario: en China, por ejemplo, se está utilizando para detectar cáncer de páncreas, y en muchos laboratorios ayuda a acelerar la investigación frente a bacterias resistentes. El problema surge cuando se confunde una herramienta de apoyo con un sustituto del criterio médico profesional.

La reflexión es clara: el peligro no está en la inteligencia artificial en sí, sino en cómo decidimos utilizarla. Mientras puede ayudarnos a avanzar en ciencia y medicina, no debería ser la guía para procedimientos delicados que ponen en riesgo nuestra salud. Y menos aún, cuando se trata de manipular agujas frente al espejo.

Fuente: Xataka.