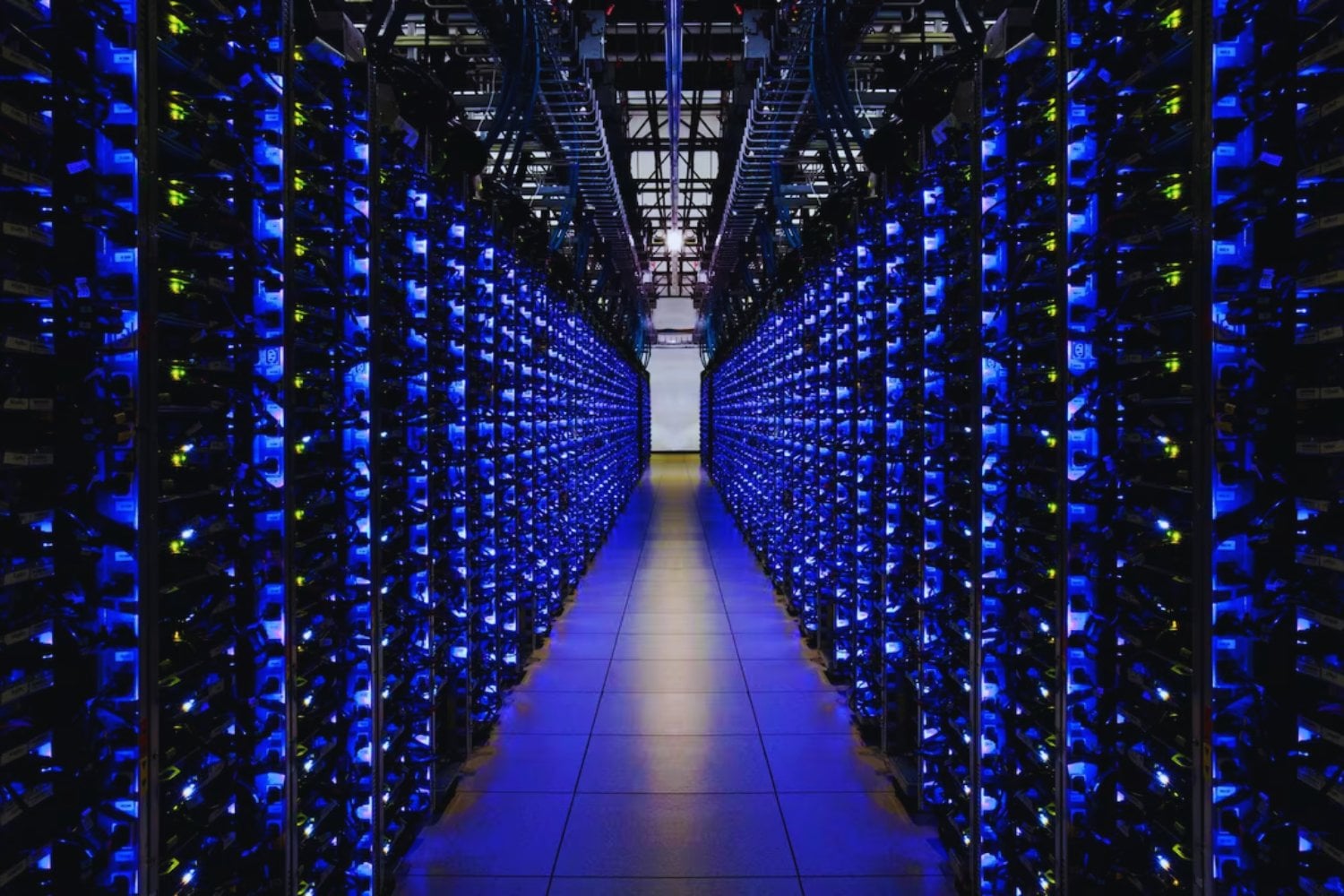

Durante un tiempo sonó como una solución casi perfecta. Si los centros de datos consumen enormes cantidades de electricidad, generan calor extremo y presionan las redes energéticas terrestres, ¿por qué no mover parte de esa infraestructura al espacio? Allí habría luz solar abundante, espacio de sobra y la posibilidad de construir a otra escala. La teoría seducía. La práctica, no tanto.

Ahora la propia SpaceX ha introducido una dosis de realidad. Según documentos dirigidos a inversores mientras prepara su futura salida a Bolsa, la compañía reconoce que los centros de datos orbitales dependen de tecnologías que todavía no han sido desarrolladas ni probadas plenamente, y que quizá nunca alcancen una viabilidad comercial sólida. No es una retirada total, pero sí una confesión importante.

La promesa de una nueva frontera digital

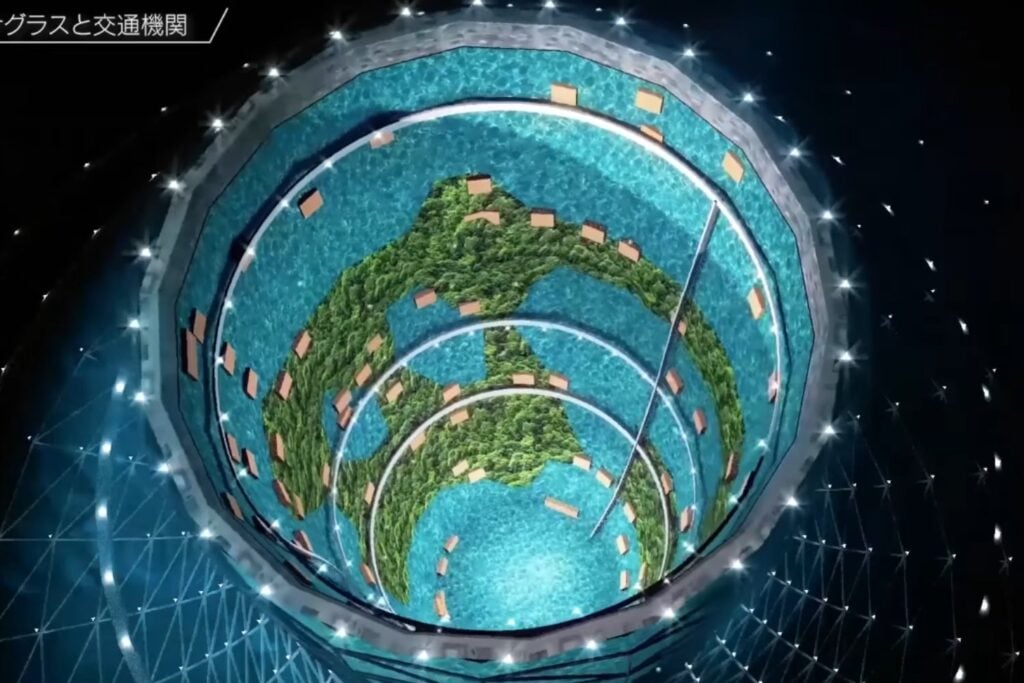

La idea ganó fuerza cuando varias figuras influyentes del sector tecnológico empezaron a hablar de ella con naturalidad. Jeff Bezos planteó que, en el futuro, ciertas industrias intensivas en energía podrían trasladarse fuera de la Tierra. Elon Musk también alimentó el debate al sugerir que una evolución de Starlink podría participar en ese escenario.

La lógica parecía clara. En órbita hay acceso privilegiado a la energía solar, ausencia de límites urbanos y la posibilidad de conectar redes espaciales con infraestructuras globales. En plena explosión de la inteligencia artificial, cualquier solución energética parece atractiva. Sin embargo, entre una visión inspiradora y un sistema funcional suele interponerse la física.

El problema que no se ve: la radiación espacial

En la Tierra, la atmósfera y el campo magnético nos protegen de gran parte de la radiación cósmica y solar. Los centros de datos actuales operan dentro de esa burbuja natural. En el espacio, esa protección desaparece en gran medida.

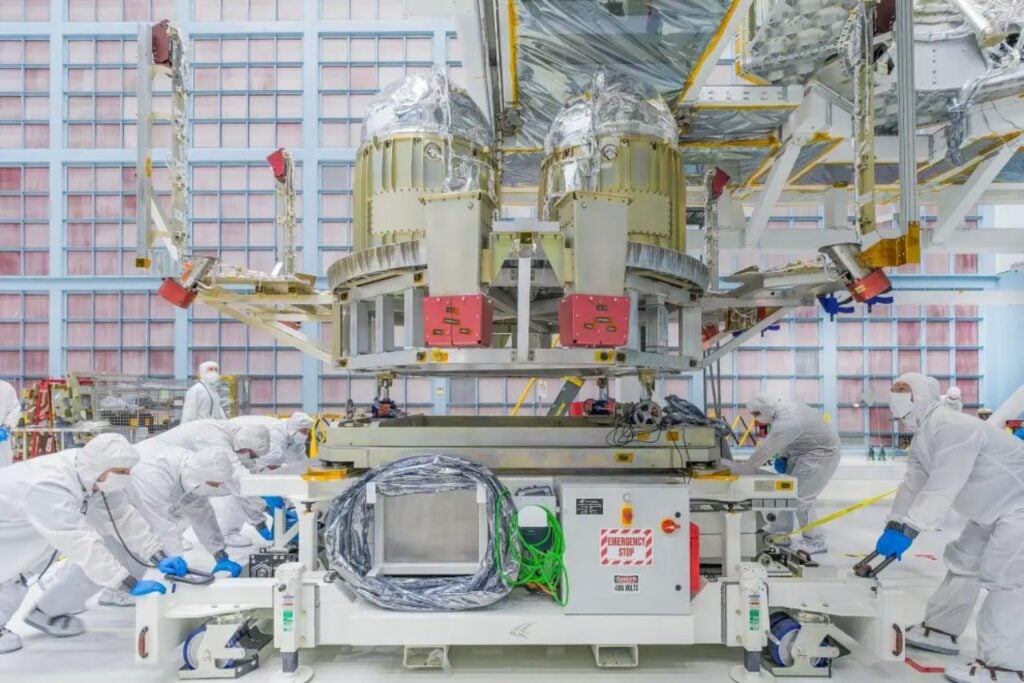

Para los chips modernos, extremadamente densos y delicados, esto representa una amenaza seria. La radiación ionizante puede provocar errores de memoria, degradación de materiales y fallos permanentes en circuitos críticos. Eso obligaría a blindajes especiales, componentes endurecidos para uso espacial o sistemas redundantes mucho más complejos. Cada una de esas soluciones añade peso, coste y dificultad operativa.

Refrigerar servidores en el vacío es aún peor

Los centros de datos terrestres dedican una enorme parte de su presupuesto energético a expulsar calor. Miles de procesadores trabajando de forma continua generan temperaturas elevadas que deben controlarse.

En la Tierra se usan aire, líquidos refrigerantes y sistemas de intercambio térmico eficientes. En el vacío espacial no existe aire que mover ni convección convencional. El calor debe disiparse mediante radiación térmica, un proceso más lento y exigente. Eso implica estructuras radiantes enormes, diseños sofisticados y una ingeniería mucho más compleja que la de una nave industrial terrestre.

Energía abundante no significa energía barata

Es cierto que en órbita la luz solar puede aprovecharse de forma muy eficiente. Pero transformar esa ventaja en suministro constante para una infraestructura informática masiva exige paneles solares gigantescos, almacenamiento robusto, electrónica avanzada y mantenimiento continuo.

Nada de eso es barato. Mucho menos si cada componente debe lanzarse al espacio. Además, cualquier reparación se convierte en una operación extremadamente costosa comparada con sustituir hardware en un centro de datos convencional.

También existe el factor tiempo

Hay otro detalle menos visible: la latencia. Para ciertos trabajos de inteligencia artificial no importa demasiado dónde esté el servidor. Para otros, cada milisegundo cuenta.

Servicios interactivos, aplicaciones en tiempo real o cargas críticas podrían seguir prefiriendo instalaciones terrestres bien conectadas por fibra óptica antes que una ruta orbital más compleja.

Lo que realmente nos está diciendo SpaceX

La compañía no ha enterrado definitivamente el concepto. Lo que ha hecho es algo más valioso: reconocer que entre la idea y el negocio existe un abismo técnico y financiero.

En una época donde muchas promesas tecnológicas se anuncian antes de madurar, esa cautela resulta significativa. Porque no todo lo que puede imaginarse merece construirse de inmediato.

El futuro quizá sea más modesto

Es posible que surjan usos concretos en defensa, ciencia, observación terrestre o procesamiento cercano a redes satelitales. Incluso podría tener sentido en futuras bases lunares o marcianas. Pero como sustituto masivo de los centros de datos terrestres en la próxima década, el escenario parece remoto.

La inteligencia artificial está empujando a buscar soluciones extremas. SpaceX acaba de recordar algo esencial: no basta con lanzar hardware al cielo. También hay que hacerlo funcionar… y que salga rentable.