No me alegra decirlo, pero el antihéroe de Patricia Highsmith en El talentoso Sr. Ripley ya no necesitaría tener talento. Los avances de la IA generativa, con su capacidad para crear videos creíbles de lo que sea, clonar voces y otro tipo de inventos pasables y creíbles sin problemas, le han quitado el arte al arte.

Un nuevo trabajo de investigación encabezado por un equipo de la Facultad de Medicina Icahn de Mount Sinai, Nueva York, ha presentado un perturbador argumento para que se vigile constantemente la amenaza de la evidencia médica “deepfake”.

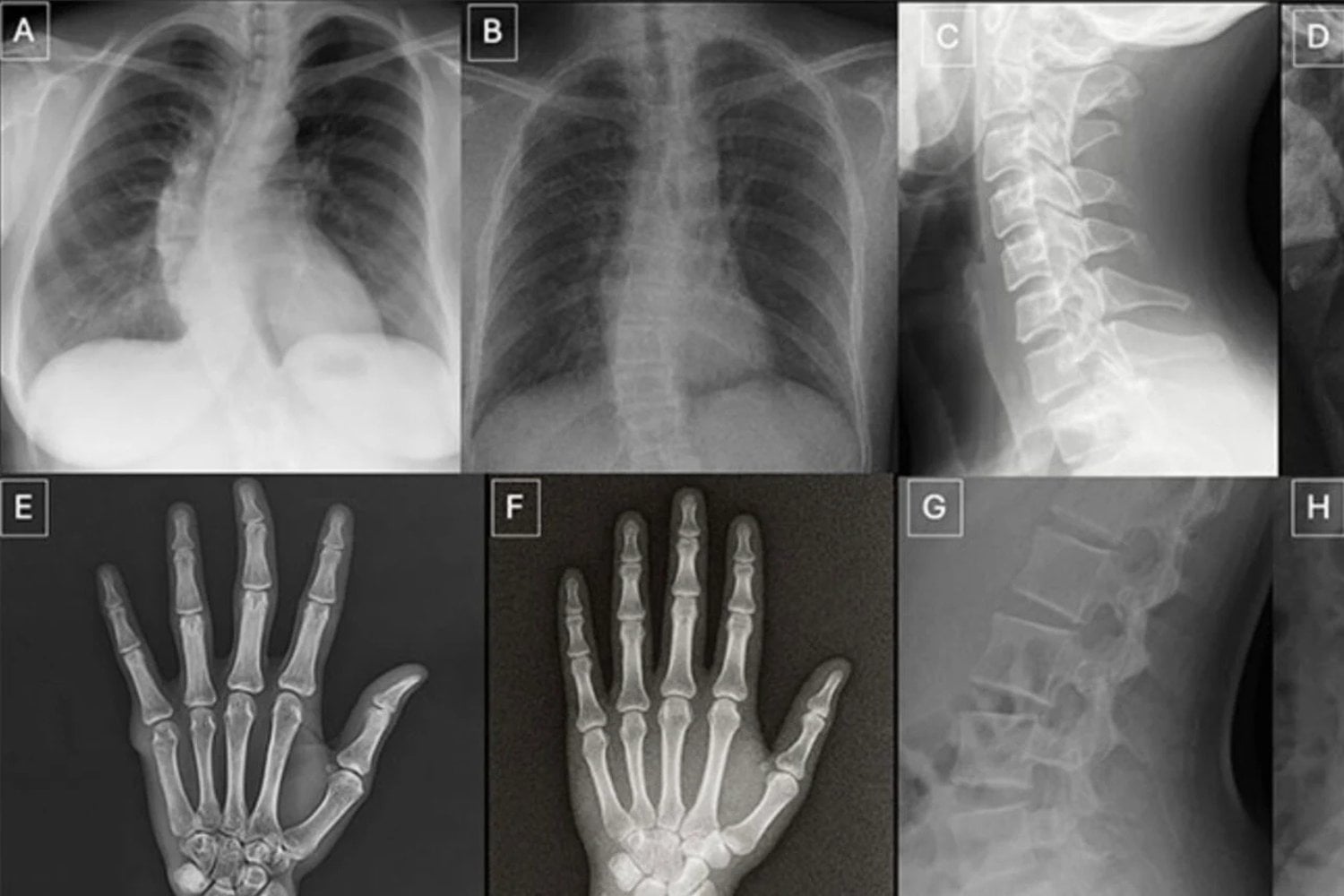

Los investigadores sometieron a un grupo de voluntarios de seis países, 17 radiólogos en actividad, a pruebas en las que se les pedía que distinguieran radiografías reales de creaciones generadas por la IA, en un grupo de 264 imágenes. Los resultados no inspiraron confianza.

“Nuestro estudio demuestra que las imágenes de rayos X que son deepfakes son lo suficientemente realistas como para engañar a los radiólogos, que son los especialistas más entrenados en imágenes médicas”, declaró para la prensa el autor principal del trabajo, Dr Mickael Tordjman, médico y miembro del posdoctorado de la Facultad Icahn, “incluso cuando sabían que en el grupo de imágenes había muchas que habían sido generadas por la IA”.

En una prueba posterior, las imágenes de rayos X generadas con IA engañaron a uno de los mismos modelos de lenguaje que se habían usado para crearlas: ChatGPT-4º de OpenAI.

El temblor de las falsificaciones

Tordjman emprendió este proyecto por su genuina preocupación ante los riesgos que se presentan para los pacientes, los médicos y la cantidad de espectadores inocentes. Las imágenes médicas creíbles generadas con la IA “crean una vulnerabilidad de alto costo para litigios fraudulentos, por ejemplo, si no se puede distinguir una fractura inventada de una real”. El problema ya captó la atención de expertos legales que buscan proteger a los jurados de los engaños ante su exposición a similares falsificaciones de la IA.

“También hay un riesgo significativo en la ciberseguridad, porque si hay hackers que logran acceder a una red hospitalaria, pueden inyectar imágenes generadas por IA para manipular los diagnósticos de los pacientes y causar un caos clínico general”, añadió Tordjman.

Los 17 radiólogos voluntarios que pusieron a prueba el equipo de Tordjman vieron dos conjuntos de datos para este estudio que se publicó el martes en Radiology. En el primer caso se pidió que los voluntarios miraran 154 imágenes de rayos X estáticas, la mitad genuinas y la otra mitad, generadas con ChatGPT-4o (77 en cada grupo). En la segunda prueba se usó un modelo especializado de IA de difusión entrenado para crear radiografías creíbles del pecho, en que se veían órganos como el corazón y los pulmones, llamado RoentGen. Se pidió a los voluntarios que discernieran cuáles eran reales y cuáles falsas. Había 55 reales y 55 falsas en el grupo de 100 radiografías.

Se les avisó a algunos radiólogos que los tres conjuntos contenían imágenes de IA, y esos radiólogos lograron discernir mejor que los que no sabían nada, aunque sus resultados no fueron excelentes. Su precisión promedio fue del 75% en comparación con el 41% de quienes no estaban al tanto de las imágenes creadas con IA.

Los 17 radiólogos del estudio tenían experiencia variada (entre 0 y 40 años en actividad) y detectaron entre el 58% y el 92% de las imágenes generadas con ChatGPT, y entre el 62% y el 78% en las imágenes de pecho RoentGen. Ni la edad ni la experiencia parecían ser factores que influyeran en la precisión para diferenciar las imágenes, pero los radiólogos musculoesqueléticos demostraron ser mejores para detectar las imágenes falsas, en comparación con otros subespecialistas.

Un juego

Tordjman y su equipo también llevaron a cabo sus pruebas en cuatro modelos multimodales: ChatGPT-4º y 5, Gemini 2.5 Pro de Google y Llama 4 Maverick de Meta. Los bots tuvieron resultados levemente peores que los de los humanos, con un 57% a 85% de precisión en las imágenes falsas de GPT-4o (particularmente vergonzoso para ChatGPT-4o).

En cuanto a las radiografías RoentGen sintéticas, la precisión de los modelos de lenguaje para detectar las que eran falsas tuvo una variación un tanto mayor, del 52% al 89%.

Tordjman dice que espera que se siga investigando el tema para establecer herramientas de detección y medidas educativas. “Las imágenes médicas falsas suelen verse demasiado perfectas”, señaló. “Los huesos son muy suaves y lisos, las columnas vertebrales son muy rectas y no se ven naturales, los pulmones se ven exageradamente simétricos, los patrones de vasos sanguíneos son excesivamente uniformes, y las fracturas se ven inusualmente limpias y consistentes”.

Aquí podrás hacer la prueba, aunque no debes sentirte mal si no logras diferenciar las imágenes. Alguien que sabe mucho de los artistas del engaño dijo: “La vida es una larga serie de malentendidos”.