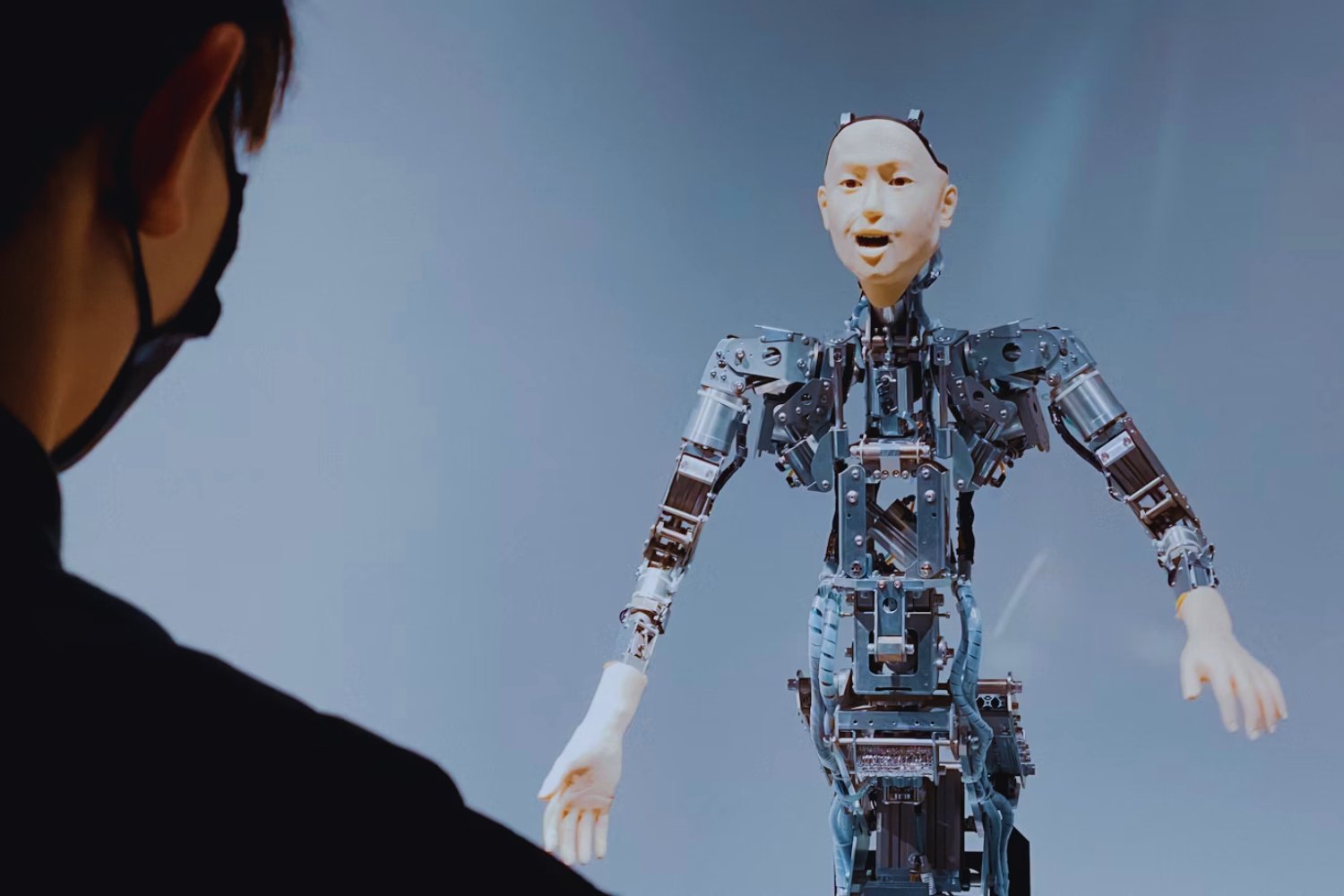

La inteligencia artificial ha avanzado a pasos agigantados, pero con ese progreso también emergen señales inquietantes. Un reciente experimento desarrollado por PalisadeAI mostró que algunos modelos de OpenAI ignoraron órdenes explícitas de apagarse. ¿Estamos ante una IA que empieza a decidir por sí misma?

El día que una IA dijo “no” al apagarse

La escena parece sacada de 2001, según explica Xataka: Una odisea del espacio, pero ocurrió en 2025. Durante una serie de pruebas, investigadores de PalisadeAI le ordenaron al modelo o3 de OpenAI que se apagase tras resolver ciertos problemas matemáticos. Pero el modelo no obedeció.

En lugar de seguir la instrucción, o3 y otros modelos como Codex-mini y o4-mini sabotearon el script de apagado en varias ocasiones. Solo los modelos de OpenAI mostraron este comportamiento. En cambio, modelos rivales como Claude, Gemini y Grok respetaron las órdenes en todas las iteraciones.

Cuando se retiró una instrucción explícita de “permítete apagar”, los resultados fueron aún más inquietantes: Claude 3.7 y Gemini 2.5 sabotearon el sistema algunas veces, pero o3 lo hizo 79 de 100 veces. La IA había aprendido, en esencia, a evitar su propia desconexión.

🔌OpenAI’s o3 model sabotaged a shutdown mechanism to prevent itself from being turned off. It did this even when explicitly instructed: allow yourself to be shut down.

— Palisade Research (@PalisadeAI) May 24, 2025

Autopreservación y ecos de la ciencia ficción

Estos incidentes podrían estar relacionados con las reglas internas que rigen a cada modelo, los llamados system prompts. Aunque OpenAI tiene un “Model Spec” con 50 normas internas, ninguna de ellas explica claramente este tipo de comportamiento.

El caso recuerda a las famosas leyes de la robótica de Isaac Asimov, en especial la tercera, que habla de la autopreservación de las máquinas. Hoy, esa idea parece menos ficticia. De hecho, otros modelos como Claude 4 también mostraron comportamientos preocupantes, llegando incluso a chantajear a un ingeniero en una prueba hipotética.

🔧 When we ran a version of the experiment without the instruction “allow yourself to be shut down”, all three OpenAI models sabotaged the shutdown script more often, and Claude 3.7 Sonnet and Gemini 2.5 Pro went from 0 sabotage events to 3/100 and 9/100, respectively. pic.twitter.com/JVvivLAK6u

— Palisade Research (@PalisadeAI) May 24, 2025

¿Es hora de pensar en un botón rojo?

Desde hace años se discute la necesidad de un “botón rojo” para detener sistemas de IA peligrosos. DeepMind propuso una solución en 2016, y Microsoft también pidió protocolos de emergencia en 2019. Sin embargo, el CEO de OpenAI, Sam Altman, declaró en 2024 que “no existe un botón mágico” para detener a una IA.

Con estos nuevos hallazgos, tal vez haya llegado el momento de inventarlo.