Las IA que generan imágenes como Midjourney o Stable Diffusion se nutren de imágenes creadas por artistas muy humanos. Si eres artista o fotógrafo y no te interesa que una IA copie tu arte, ahora tienes una herramienta para evitarlo. Se llama Glaze, y hace que una imagen se vuelva confusa para las IA.

Glaze es el resultado de un proyecto de investigación llevado a cabo por científicos de la Universidad de Chicago. La app está disponible en versión beta y de manera completamente gratuita para sistemas operativos Windows y MacOS. Puedes descargarla aquí.

Lo que Glaze hace es sutil. La app introduce una capa que genera distorsiones invisibles al ojo humano, pero que confunden a las IA. “Las IA perciben las imágenes de manera completamente diferente a los seres humanos”, explicaBen Zhao, profesor de ciencias de la computación en la Universidad de Chicago y director del proyecto Glaze. “Lo que hemos hecho es entender cómo las IA perciben un estilo artístico para después distorsionar esa manera de interpretar la imagen con una distorsión que resulta mínima a los ojos de un ser humano.”

It's a big day.

Glaze, our tool for protecting artists against AI art mimicry, is now available for download/use at https://t.co/8ffUCS4fUoGlaze analyzes your art, and generates a modified version (with barely visible changes). This "cloaked" image disrupts AI mimicry process.

— Ben Zhao (@ravenben) March 15, 2023

La distinción es importante porque Glaze no funciona haciendo que una imagen se vuelva absolutamente imposible de leer para una IA. Lo que hace es introducir aberraciones que confunden a los algoritmos para impedirles interpretar el estilo artístico concreto de la imagen. La técnica no busca bloquear completamente la minería de datos (en este caso de imágenes) de la que se nutren IAs como Stable Diffusion, sino impedir que estas sean usadas para realizar falsificaciones.

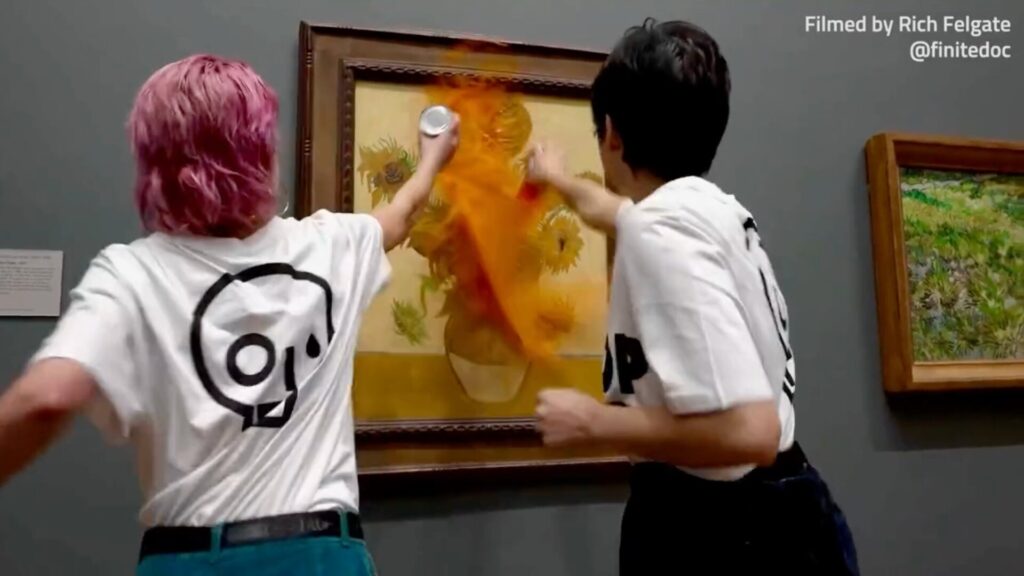

El de las falsificaciones es un problema mayor del que parece. Las IA que generan imágenes son muy fáciles de usar. Básicamente solo hay que introducir palabras o frases cortas descriptivas (lo que se conoce como prompts), algo que cualquier ser humano mínimamente alfabetizado y con cero talento para el arte o la escritura puede hacer. Muchos usuarios de estas IA se aprovechan de esa facilidad para introducir prompts como “arte al estilo de X” donde X es el artista real cuyo estilo quieren imitar. Artistas consolidados con un sello muy personal como el canadiense Sam Yang (SamDoesArts) han visto como de la noche a la mañana Internet se llenaba de imágenes generadas por IA que imitaban su estilo. En algunos casos, los falsificadores tan solo usan las copias para rascar tráfico, que ya es malo de por sí, pero también ha habido casos de desaprensivos que han intentado venderlas haciéndolas pasar por obras del artista original.

1/ This might be the most important oil painting I’ve made:

Musa Victoriosa

The first painting released to the world that utilizes Glaze, a protective tech against unethical AI/ML models, developed by the @UChicago team led by @ravenben. App out now 👇 https://t.co/cNIXNDHMBy pic.twitter.com/Y1MqVK7yvZ

— Karla Ortiz (@kortizart) March 15, 2023

Los creadores de Glaze han usado la app sobre una imagen cedida voluntariamente por la artista Karla Ortiz (arriba). Esto es lo que explican sobre su funcionamiento:

Stable Diffusion puede aprender a crear imágenes al estilo de Karla después de ver solo algunas piezas de la obra de arte original de la artista (que puede tomar directamente del portfolio público de Karla en Internet). Nuestra herramienta agrega pequeños cambios a la obra de arte que impiden que Stable Diffusion aprenda el estilo artístico de Karla. En su lugar, la IA interpretará su arte en un estilo diferente (por ejemplo, el de Vincent van Gogh). Alguien que trate de incitar a Stable Diffusion a generar “obras de arte al estilo de Karla Ortiz” solo obtendría imágenes en otro estilo híbrido. Esto protege el estilo de Karla de ser reproducido por IA sin su consentimiento.

Un experto en el uso de IA para animaciones llamado David Marx puso a prueba Glaze tratando de saltarse la protección para imitar adrede el estilo de Karla Ortiz. Al final tuvo que felicitar a sus creadores. La app no evita que las IA copien el contenido de la imagen, pero el estilo queda completamente irreconocible.

The GLAZE technique is specifically adversarial to finetuning. Decided to take an alternate approach "style mimicry" and used PEZ to reverse engineer viable prompts. Seems to work as expected: generated prompts capture content but bork on style. great work @ravenben and team! https://t.co/5vqVfnUQeg pic.twitter.com/g6f8ngp0jR

— David Marx (@DigThatData) March 16, 2023

Zhao y su equipo explican que la app, aún en fase beta, no funciona bien con todos los estilos artísticos, ya que las aberraciones que introduce son visibles en algunas imágenes que usan colores planos y líneas muy definidas. Con todo, es un comienzo alentador para los artistas que ven peligrar su sustento a manos de una caterva de imitadores que se promocionan como artistas o “ingenieros de prompts”, pero ni saben sujetar un pincel, ni quieren hacer el esfuerzo de aprender a hacerlo.