La inteligencia artificial está avanzando a una velocidad enorme, pero debajo de esa carrera hay un problema cada vez más difícil de ignorar: su coste energético. Entrenar modelos grandes, mover datos constantemente entre memoria y procesador y mantener centros de datos funcionando día y noche implica un gasto eléctrico gigantesco. Y el problema no es solo de escala, sino de arquitectura. Buena parte del hardware actual sigue funcionando con una lógica que obliga a separar dónde se guarda la información y dónde se procesa, un diseño eficiente durante décadas, pero cada vez menos adecuado para la IA moderna.

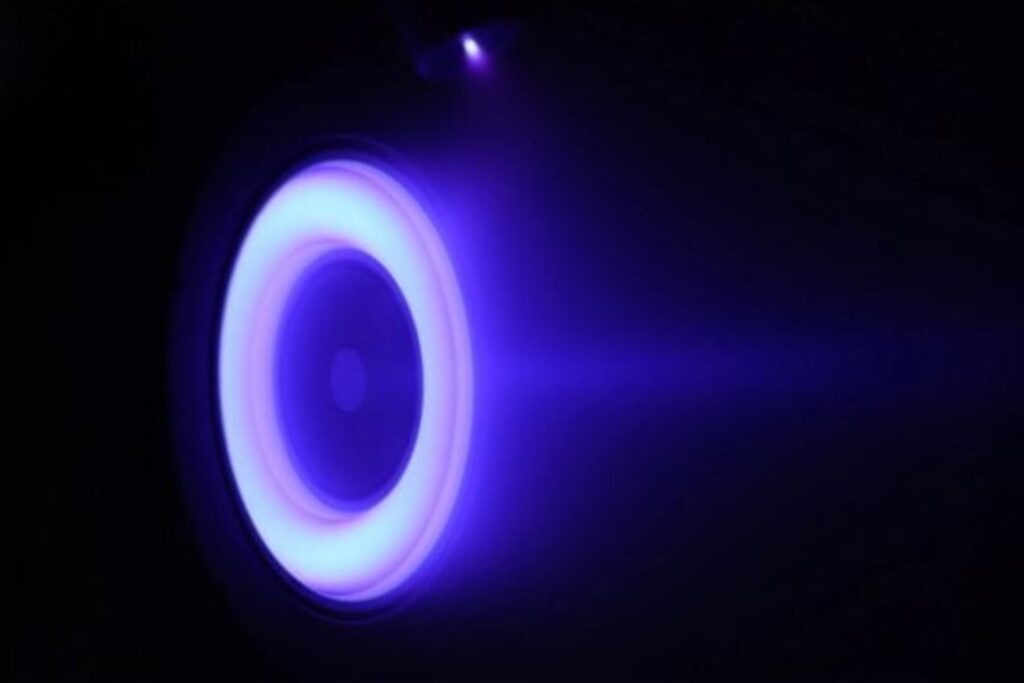

Ahí es donde entra uno de los conceptos más prometedores de la computación de nueva generación: la computación neuromórfica, una línea de investigación que intenta construir chips inspirados no en el ordenador clásico, sino en el cerebro. La idea no es replicar la mente humana, sino copiar una de sus grandes ventajas físicas: procesar y almacenar información casi en el mismo lugar, con un consumo de energía muchísimo menor.

El avance no está en “hacer pensar” al chip, sino en hacerlo más parecido a una sinapsis

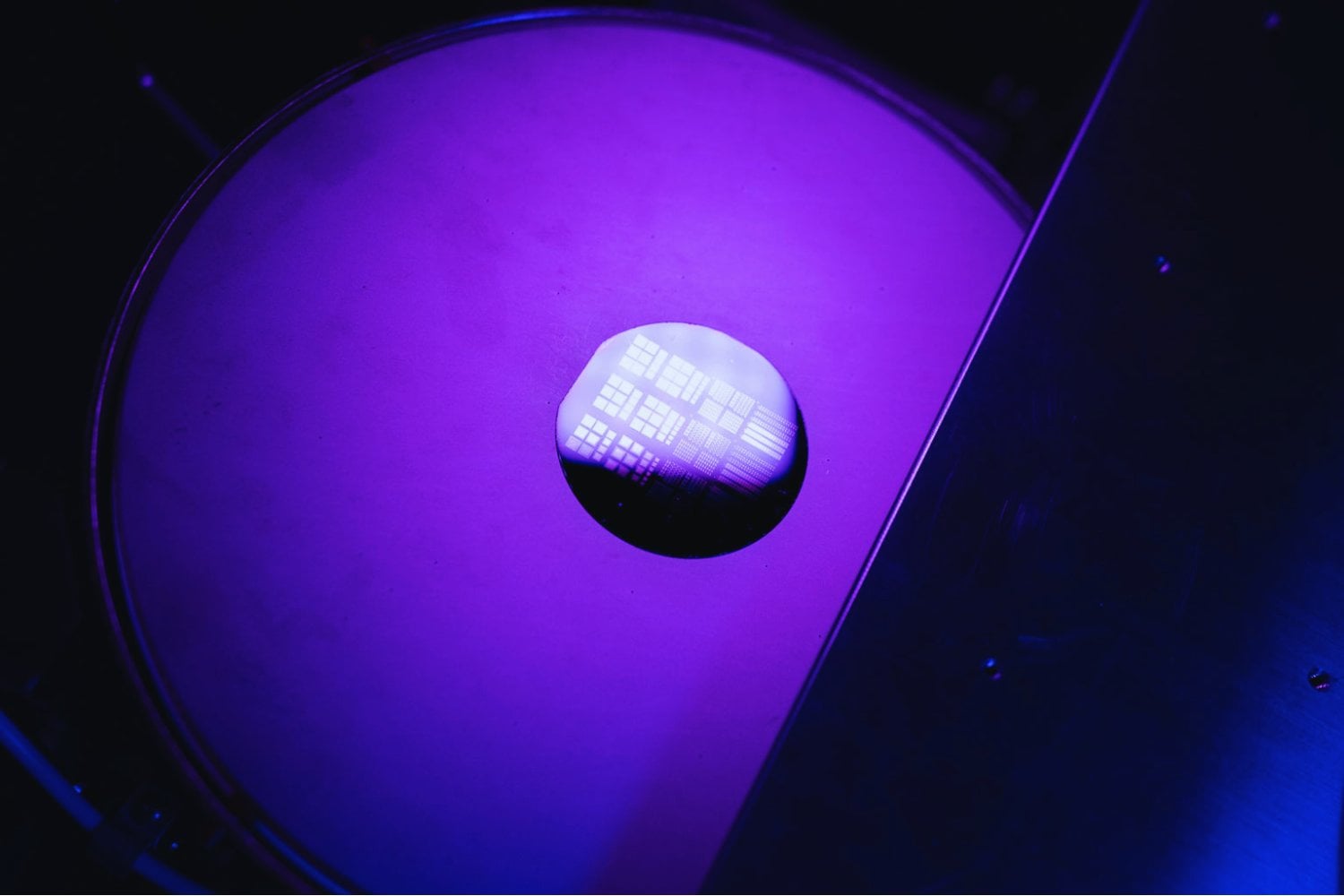

Ese es el punto importante del trabajo liderado por la Universidad de Cambridge y publicado en Science Advances. El equipo ha desarrollado un nuevo tipo de memristor, un componente electrónico capaz de modificar su resistencia eléctrica de forma gradual y “recordar” estados previos. Ese comportamiento lo convierte en una pieza especialmente interesante para construir hardware que aprenda, se adapte y procese información de una forma más flexible que los chips tradicionales.

El dispositivo está basado en una película delgada de óxido de hafnio dopado con estroncio y titanio, un material que permite un comportamiento mucho más estable y uniforme que otros diseños previos. Eso importa porque uno de los grandes problemas históricos de los memristores era precisamente su falta de fiabilidad: muchos funcionaban bien en teoría, pero de forma demasiado errática en la práctica como para ser realmente útiles.

Según los investigadores, este nuevo diseño logra una respuesta mucho más controlada porque no depende de filamentos internos inestables, sino de cambios más finos en la interfaz del material. Dicho de forma menos técnica: el chip no solo responde, sino que lo hace de una forma más predecible, gradual y repetible, algo fundamental si se quiere usar en sistemas complejos de IA.

La gran promesa está en reducir el gasto energético donde hoy más se desperdicia

El verdadero valor del avance no está tanto en la velocidad bruta, sino en la eficiencia. En los chips convencionales, una parte enorme del gasto energético se pierde simplemente en transportar datos entre distintas zonas del sistema. Esa transferencia constante genera consumo, calor y límites físicos cada vez más difíciles de escalar.

El cerebro funciona de otra manera. Las sinapsis no distinguen tan claramente entre “guardar” y “usar” la información. Por eso, aunque el cerebro humano sea infinitamente más complejo que cualquier chip actual, opera con una eficiencia energética que sigue dejando en ridículo a muchos sistemas informáticos.

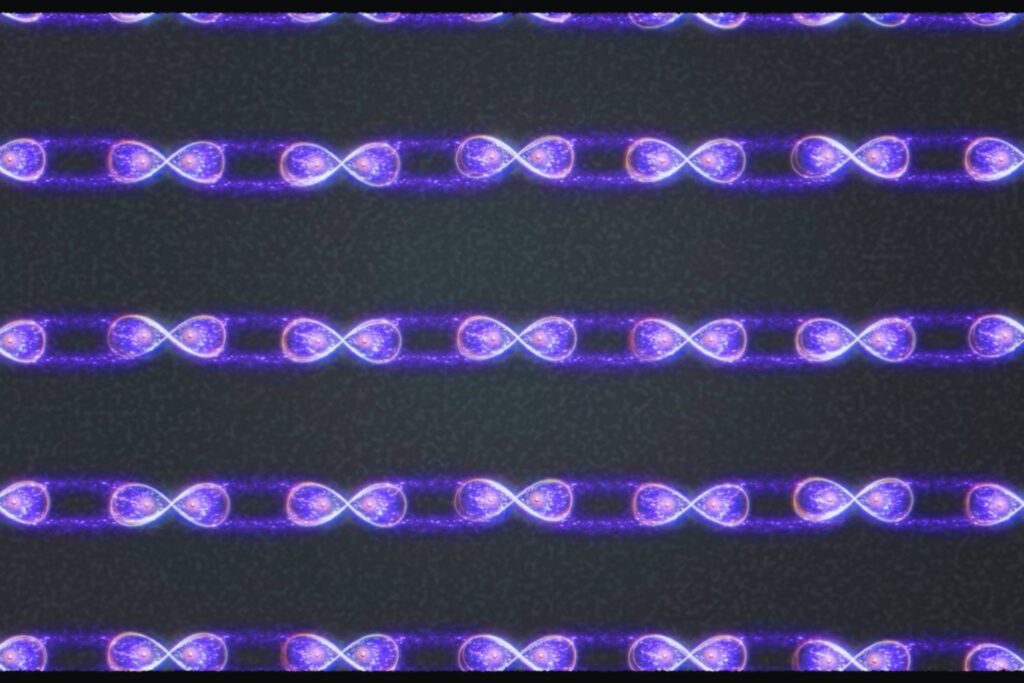

El nuevo memristor desarrollado en Cambridge apunta justamente a ese modelo. Los experimentos muestran que puede almacenar múltiples niveles de conductancia, no solo un “encendido” o “apagado” binario, y además reproducir comportamientos inspirados en la plasticidad sináptica, es decir, la forma en que las conexiones neuronales se fortalecen o debilitan según la experiencia. Esa propiedad lo vuelve especialmente útil para sistemas de aprendizaje automático más compactos y menos dependientes de arquitecturas masivas. El equipo sostiene que este tipo de enfoque podría reducir el consumo energético de ciertos procesos de IA en torno a un 70%, una cifra muy ambiciosa, pero suficientemente seria como para captar mucha atención en el sector.

Todavía no estamos ante una revolución industrial inmediata, pero sí ante un cambio de dirección importante

Como ocurre con casi todos los avances prometedores en hardware, todavía hay distancia entre el laboratorio y el mercado. El propio equipo reconoce que este material requiere procesos de fabricación a temperaturas cercanas a los 700 grados Celsius, lo que complica su integración directa en las líneas industriales actuales. También falta comprobar cómo escalaría este tipo de componente en sistemas más complejos y fuera de condiciones experimentales muy controladas.

Aun así, el hallazgo importa porque apunta justo a uno de los cuellos de botella más serios del presente. La IA puede seguir mejorando en software, pero si el hardware sigue arrastrando diseños pensados para otra época, el coste energético terminará pesando cada vez más. Por eso, más que una curiosidad de laboratorio, este tipo de chip representa una señal bastante clara de hacia dónde se está moviendo una parte importante de la investigación: menos obsesión con hacer simplemente más cálculo, y más interés en rediseñar cómo se calcula.

Y ahí, por extraño que suene, el cerebro sigue siendo uno de los mejores ingenieros que tenemos como referencia.