un encuesta de los principales científicos de IA dice que hay un 5 % de posibilidades de que la IA se vuelva incontrolable y acabar con la humanidad. A corto plazo, los investigadores estiman que la IA será significativamente más avanzada y capaz de crear una canción pop Top 40 y escribir una Bestseller del NYT antes de 2030. Así que al menos nuestros señores supremos de la IA nos entretendrán antes de que nos maten.

“Si bien las predicciones de los expertos en IA no deben verse como una guía confiable hacia la verdad objetiva, pueden proporcionar una pieza importante del rompecabezas. ”, dijeron investigadores de Berkeley y la Universidad de Oxford que realizaron el estudio en diciembre. “Su familiaridad con la tecnología y la dinámica de su progreso pasado los coloca en una buena posición para hacer conjeturas fundamentadas sobre el futuro de la IA”.

La encuesta preguntó a 2.778 científicos que habían publicado estudios de IA revisados por pares sobre sus predicciones para el futuro. ¿La sensación abrumadora? Incertidumbre.

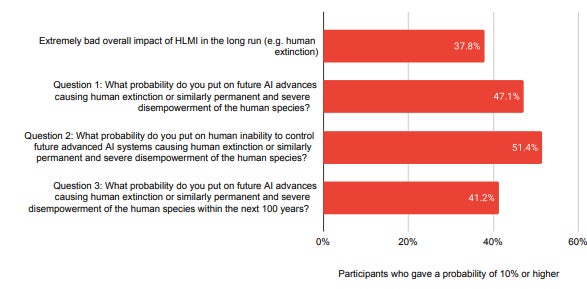

Aproximadamente el 68% de los investigadores piensa que los buenos resultados de la IA sobrehumana son más probables que los malos, pero aproximadamente la mitad de estos optimistas dan una posibilidad de extinción humana distinta de cero. El estudio destaca el peligro percibido en torno a la creación de una poderosa inteligencia artificial por parte de los principales investigadores del mundo. Hubo un amplio acuerdo en que la investigación dirigida a minimizar los riesgos de la IA debería tener más prioridad, pero los investigadores estaban divididos sobre si el progreso de la IA en en general debe acelerar o reducir la vez.

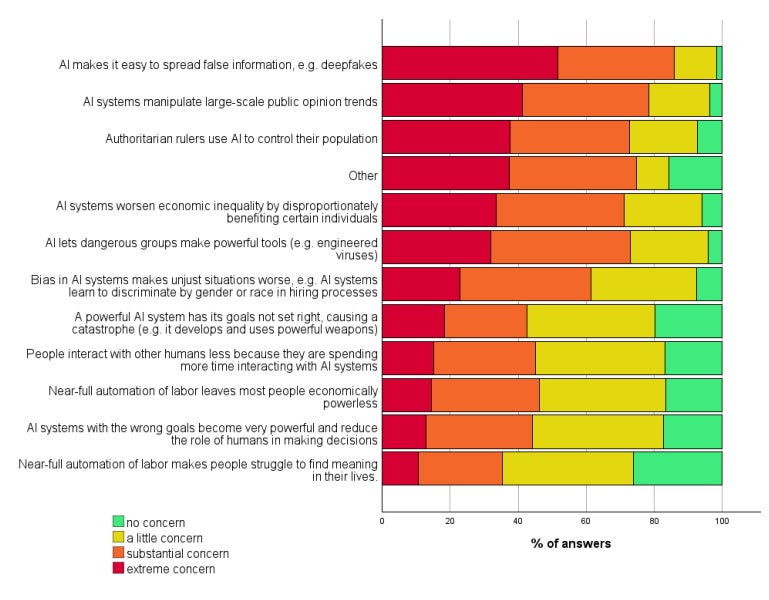

Más del 80% de los investigadores de IA expresaron una preocupación “extrema” o “sustancial” acerca de que la IA permita la difusión de información errónea. La mayoría de los investigadores expresaron preocupaciones similares sobre los gobernantes autoritarios que utilizan la IA para controlar su población, los sistemas de IA que empeoran la desigualdad económica y el papel de la IA en la creación de virus diseñados. La encuesta parece ser la más grande de su tipo hasta la fecha.

Los principales creadores de IA de Estados Unidos hacen referencia a la seguridad en sus declaraciones de misión. En diciembre, OpenAI publicó su primer documento sobre alinear una IA sobrehumana con valores humanos. Anthropic tiene un constitución colocado sobre sus sistemas de IA para garantizar que actúen en alineación con las reglas de nuestra sociedad. Pero, estos métodos realmente funcionarán con modelos de IA ¿Más inteligentes que los humanos? Eso aún está por verse porque la IA actual no es tan inteligente.

Los investigadores dieron sus mejores estimaciones sobre cuándo la sociedad logrará 39 avances importantes en la IA. Los expertos anticipan que la IA podrá ensamblar LEGO, traducir nuevos idiomas y crear videojuegos antes de 2033. Para 2063, los investigadores estiman que la IA podría hacer el trabajo de un cirujano o incluso de un Investigador de IA.