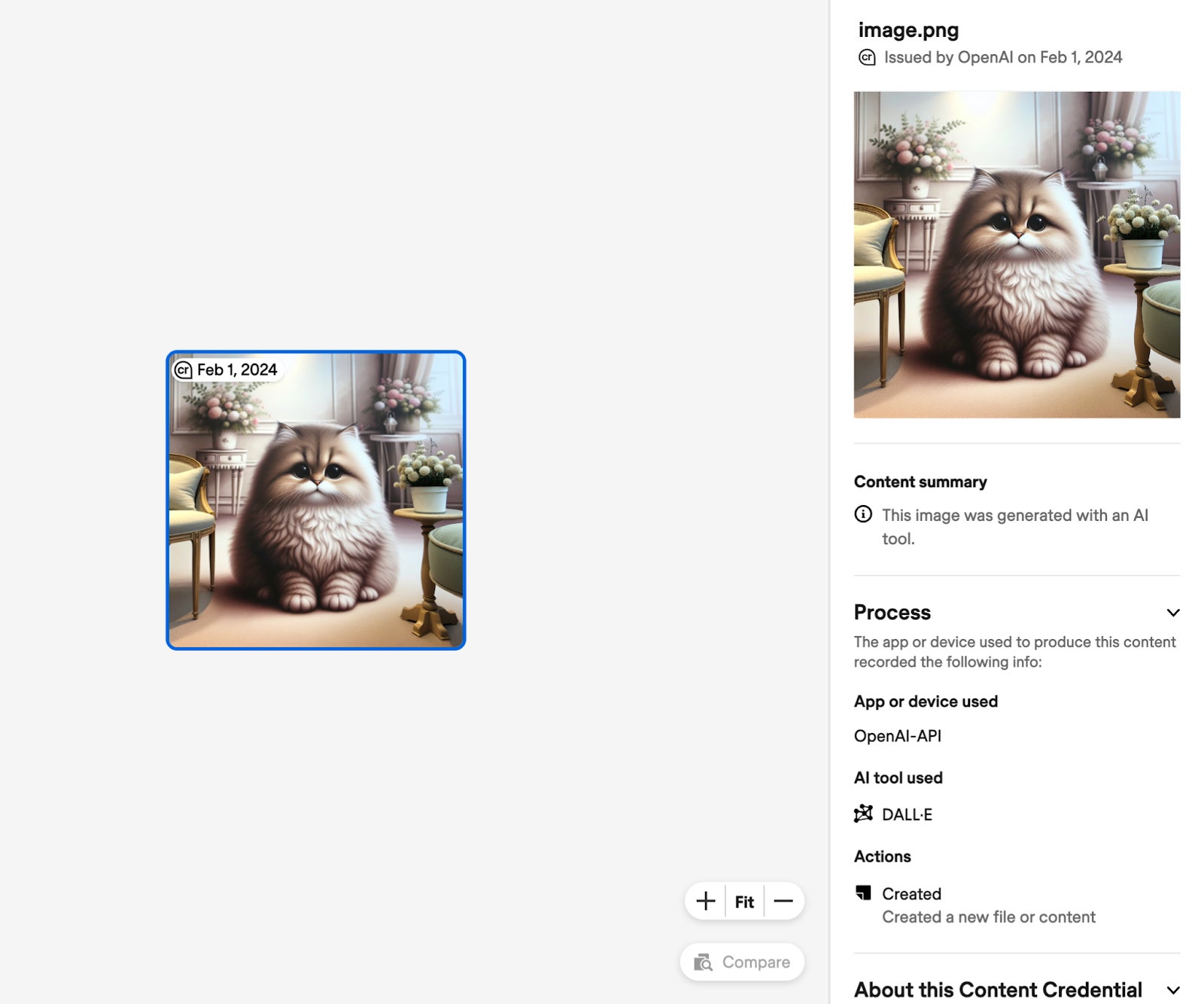

OpenAI anunció que agregará marcas de agua a las imágenes generadas por sus herramientas de inteligencia artificial el martes, en un esfuerzo para combatir los crecientes temores sobre el inminente tsunami de deepfake. Las imágenes creadas con DALL-E y otros servicios de OpenAI incluirán una marca de agua visual y otros detalles sobre su origen en los metadatos: información codificado en el archivo generado. Aquí está el problema: todo lo que tienes que hacer para eliminar la marca de agua de metadatos es tomar una captura de pantalla. Eso significa La “solución” de OpenAI podría dejarle más confundido, no menos, una vez que entre en vigor.

Imagínese mirar una imagen sospechosa. Si verifica y descubre la marca de agua de la IA, caso cerrado. Pero si está mirando una IA -imagen generada a la que se le ha quitado la marca de agua, verificar los metadatos podría darle una falsa sensación de seguridad. En otras palabras, buscar la marca de agua podría significar que tiene menos información que cuando empezó.

La propia OpenAI explica que ustedes podrían incluso eliminar la marca de agua por accidente. Cuando suben una imagen a las redes sociales, la mayoría de las plataformas automáticamente eliminar metadatos del archivo porque a veces puede revelar la información personal de un usuario. Entonces, cuando publicas una de tus creaciones de IA en Instagram, podrías causar involuntariamente un fiasco de imagen falsa.

La empresa sostiene que esto sigue siendo una buena idea. “Creemos que adoptar estos métodos para establecer la procedencia y alentar a los usuarios a reconocerlos Las señales son clave para aumentar la confiabilidad de la información digital”, escribió OpenAI en un publicación de blog. Sin embargo, la empresa admite que la marca de agua “no es una solución milagrosa”. OpenAI no respondió de inmediato a una solicitud de comentarios.

OpenAI no puede asumir toda la culpa aquí. La compañía está adoptando un nuevo estándar desarrollado por la Coalición para la procedencia y autenticidad del contenido ( C2PA), una iniciativa encabezada por Adobe en asociación con una variedad de empresas, entre ellas Arm, la BBC, Intel, Microsoft y Nueva York. Times y X/Twitter. Meta anunció que añadirá sus propias etiquetas a imágenes generadas por IA, aunque no está claro exactamente cómo la empresa planea integrar el estándar C2PA.

Ya puedes ejecutar una imagen a través de un sistema de verificación de IA desarrollado con C2PA llamado Contenido Credenciales Verificar. Simplemente no asumas que estás a salvo si tu imagen aparece clara.