Esta semana, la revista científica Frontiers in Cell and Developmental Biology publicó una investigación que presenta imágenes falsas realizadas con Midjourney, uno de los Los generadores de imágenes AI más populares.

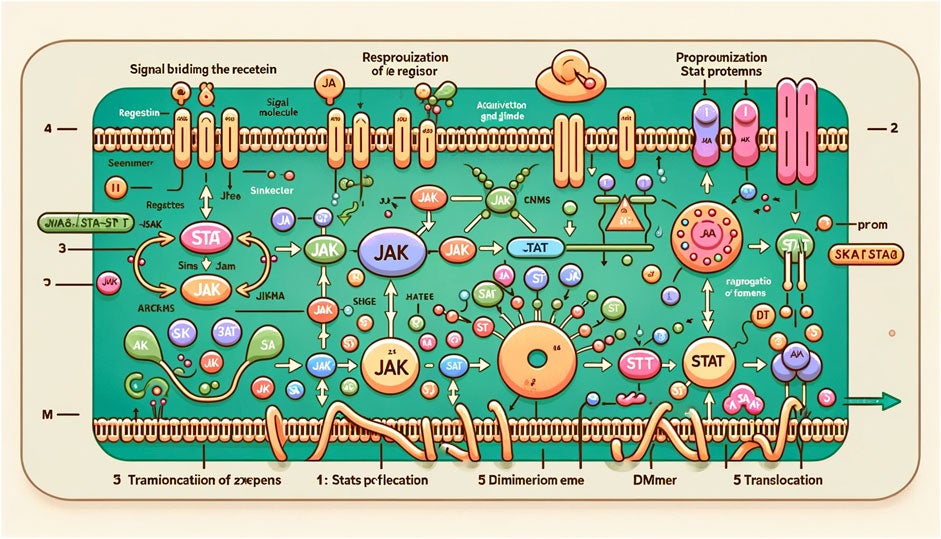

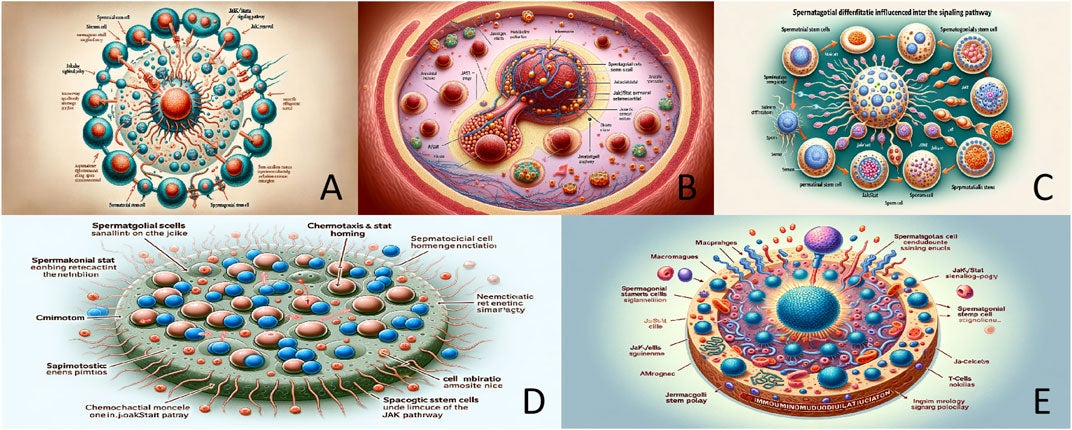

El acceso abierto papel explora la relación entre las células madre en los testículos de mamíferos y una vía de señalización responsable de mediar la inflamación y el cáncer en las células. El documento está escrito El contenido no parece ser falso, pero sus aspectos más llamativos no están en la investigación en sí. Más bien, son los datos inexactos. y representaciones grotescas de testículos de rata, vías de señalización y células madre.

El diagrama de rata generado por IA muestra una rata (útil y correctamente etiquetada) cuya parte superior del cuerpo está etiquetada como “células madre sentólicas”. para ser un pene de rata muy grande, está etiquetado «Dissilced», con inserciones a la derecha para resaltar la «célula iollotte sserotgomar », «dck, ” y “Retat”. Hmm.

Según Pautas del editor de Frontiers, los manuscritos están sujetos a “controles de calidad iniciales” por parte del equipo de integridad de la investigación y el editor responsable antes del proceso de revisión por pares. En otras palabras, muchos ojos supuestamente revisaron este trabajo antes de que las imágenes fueran publicadas.

Para crédito de los investigadores, afirman en el artículo que las imágenes del artículo fueron generadas por Midjourney. Pero Frontiers sitio para políticas y publicaciones de ética señala que podrán presentarse correcciones si “hay un error en una figura que no altera las conclusiones» o “hay figuras mal etiquetadas”, entre otros factores. Las imágenes generadas por IA ciertamente parecen caer dentro de esas categorías. Dingjun Hao, investigador de Xi’an La Universidad Jiaotong y coautor del estudio no respondieron de inmediato a la solicitud de comentarios de Gizmodo.

La imagen de la rata es evidentemente errónea, incluso si nunca se han abierto los genitales de una rata. Pero las otras figuras del artículo podrían pasar como creíble para el ojo inexperto, al menos a primera vista. Sin embargo, incluso alguien que nunca haya abierto un libro de texto de biología vería, Tras un mayor escrutinio, se descubrió que las etiquetas de cada diagrama no son del todo inglesas. signo revelador de texto generado por IA en imágenes.

El artículo fue editado por un experto en reproducción animal del Instituto Nacional de Investigación Láctea de la India y revisado por investigadores de Northwestern Medicine y el Instituto Nacional de Nutrición y Fisiología Animal. Entonces, ¿cómo se publicaron estas extravagantes imágenes? Frontiers in Cell and Developmental Biología no respondió inmediatamente a una solicitud de comentarios.

El generador de texto OpenAI ChatGPT es lo suficiente competente para obtener farkakte investiga más allá de los ojos supuestamente perspicaces de los revisores. Un estudio realizado por investigadores de la Universidad Northwestern y la Universidad de Chicago descubrió que expertos humanos fueron engañados por resúmenes científicos producidos por ChatGPT 32% del tiempo.

Entonces, solo porque las ilustraciones son claramente un sinsentido de cosplay como ciencia, no deberíamos pasar por alto la capacidad de los motores de IA para hacer pasar BS como real. . Fundamentalmente, advirtieron los autores del estudio, los artículos generados por IA podrían causar una crisis de integridad científica. Parece que esa crisis puede estar en marcha .

Alexander Pearson, científico de datos de la Universidad de Chicago y coautor de ese estudio, señaló en ese momento que la “tecnología de texto generativo Tiene un gran potencial para democratizar la ciencia, por ejemplo, haciendo más fácil para los científicos que no hablan inglés compartir su trabajo con el público en general. comunidad”, pero “es imperativo que pensemos detenidamente en las mejores prácticas de uso”.

La mayor popularidad de la IA ha causado imágenes científicamente inexactas para abrirse camino en publicaciones científicas y artículos de noticias. Las imágenes de IA son fáciles de crear y, a menudo, visualmente atractivas, pero la IA es tan difícil de manejar y, como era de esperar, resulta difícil transmitir todos los matices de la precisión científica en una solicitud de diagrama o ilustración.

El periódico reciente está muy lejos de los periódicos falsos de años pasados, un panteón que incluye éxitos como “¿Cuál es el problema con las aves?” y el Viaje a las estrellas-trabajo temático “Rápido cambio genético y morfológico del desarrollo después de una celeridad extrema.”

A veces, un artículo que pasa la revisión por pares es simplemente divertido. Otras veces, es una señal de que”fábricas de papel” están produciendo las llamadas investigaciones que no tienen mérito científico. En 2021, Springer Nature fue obligado a retractar 44 papeles en la Revista Árabe de Geociencias por ser una completa tontería.

En este caso, la investigación puede haber estado bien, pero todo el estudio queda en entredicho por la inclusión de imágenes generadas por Midjourney. Al lector promedio le puede resultar difícil considerar las vías de señalización cuando todavía está ocupado contando exactamente cuántas bolas se supone que debe hacer la rata. tener.

Más: ChatGPT escribe lo suficientemente bien como para engañar a los revisores científicos