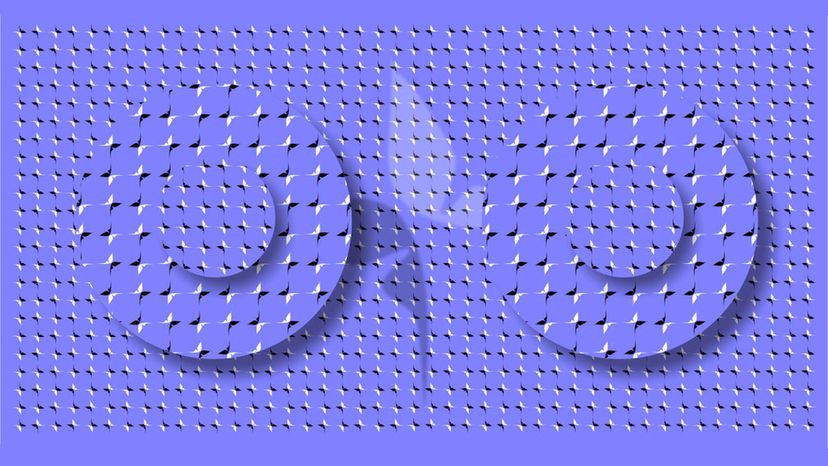

¿Qué ves en estas dos imágenes? Lo de la izquierda es un gato, pero ¿y lo de la derecha? ¿Es un gato o un perro? Si no estás seguro de la respuesta es que la imagen ha cumplido su propósito. Está pensada para engañar a una inteligencia artificial, y el hecho de que pueda engañar a una persona es muy preocupante.

En realidad, ambas imágenes corresponden al mismo gato, pero la de la derecha ha sido sutilmente alterada introduciendo ruido en una determinada zona de manera que nuestro cerebro duda si clasificarlo como gato o como perro. Cuánto más rápida es la respuesta que se nos pide, más posibilidades hay de confusión.

La imagen es uno de los ejemplos generados por un algoritmo creado por un grupo de científicos que trabajan en Google Brain. El algoritmo es una prueba de concepto pensada precisamente para engañar a redes neurales convolucionales pensadas para el reconocimiento de imágenes.

Estas redes funcionan mediante algoritmos de aprendizaje máquina que clasifican contenidos a medida que los aprenden. La red examina miles de fotos de gatos y aprende a reconocer un gato. Suena muy humano, pero en realidad estas redes están a años luz del funcionamiento de un cerebro humano. Las personas no solo reconocemos rasgos, sino que además identificamos patrones y ambigüedades de una manera holística que ningún algoritmo ha logrado imitar hasta ahora. Esa es la razón por la que para engañar a una de estas redes neurales a veces basta con cambiar un solo pixel o introducir un objeto extraño.

El problema es que el algoritmo creado por los ingenieros de Google Brain no solo es bueno engañando a otros algoritmos. También es bueno engañando a personas.

Para probar su creación, los ingenieros pusieron a prueba a varios voluntarios identificando fotos sutilmente manipuladas por el algoritmo junto a imágenes de control. Los voluntarios apenas disponían de unos pocos milisegundos para contestar y aún así acertaron mucho más en una batería de fotos que engaña a las redes CNN el 100% de las veces. Sin embargo, los investigadores han encontrado que las imágenes diseñadas para confundir a un algoritmo también confunden a personas más de lo que esperaban.

La imagen del gato que ilustra este post es especialmente perturbadora porque la confusión es persistente incluso aunque la miremos durante un buen rato. La mayor parte de las imágenes creadas por el algoritmo no son tan eficientes, pero pueden llegar a serlo. Los investigadores creen que algoritmos como este pueden usarse para manipular la percepción humana de manera muy sutil. El ejemplo que ponen es inquietante: cargar el algoritmo con los rasgos que el cerebro identifica como de una persona digna de confianza y aplicarlos a la imagen de un político en campaña. El futuro a lo Black Mirror puede estar más cercano de lo que pensamos. [Arxiv vía IEEE Spectrum]