Hay una costumbre bastante instalada en la industria tecnológica: anunciar el futuro como si ya hubiera ocurrido. A veces funciona para vender visión. Otras, simplemente sirve para hinchar expectativas. Y con la AGI (la famosa inteligencia artificial general) estamos entrando de lleno en esa fase en la que algunos directivos hablan como si ya hubiéramos cruzado una meta que, en realidad, sigue bastante borrosa.

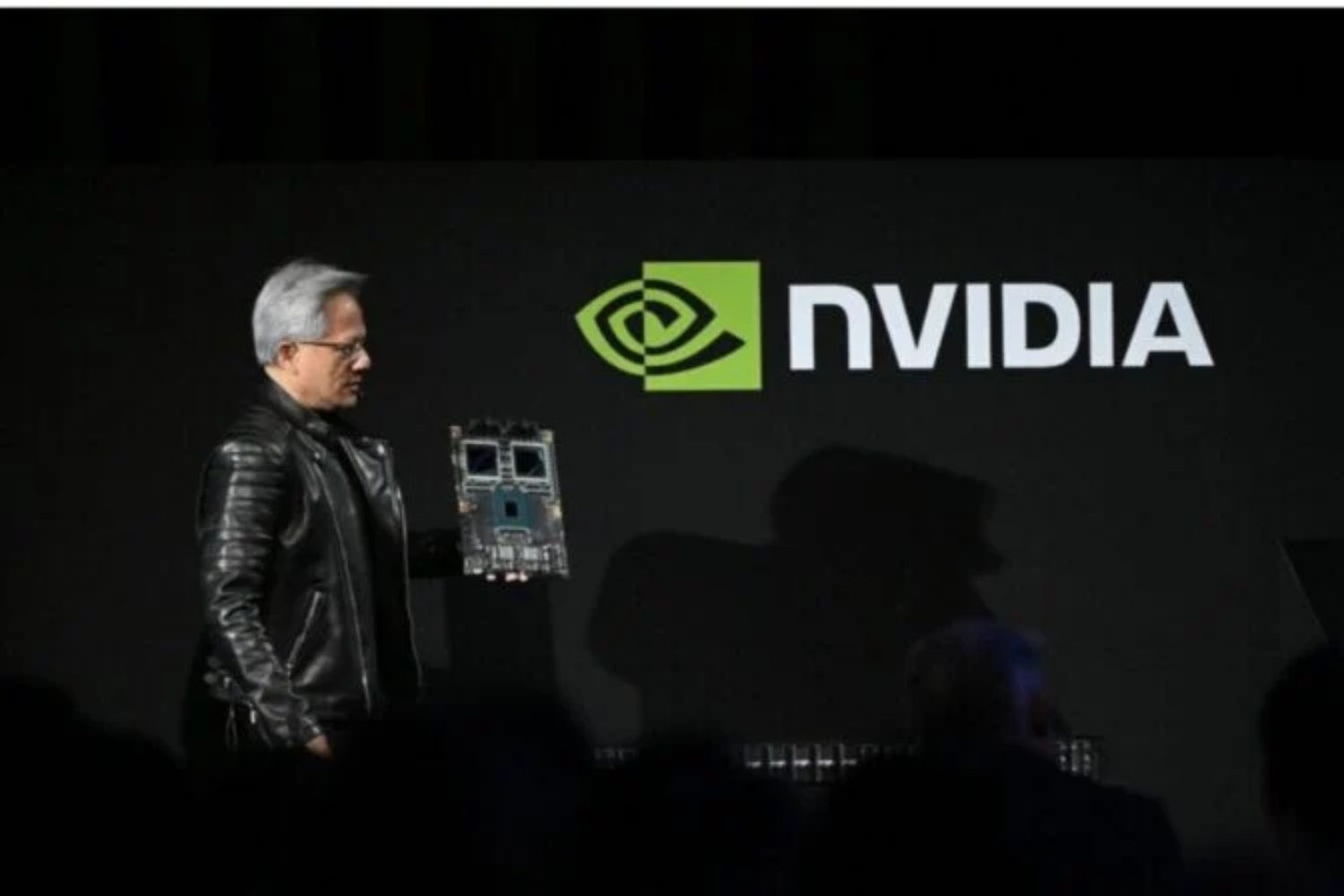

El último en hacerlo ha sido Jensen Huang, CEO de NVIDIA, durante una conversación en el pódcast de Lex Fridman. Allí soltó una frase de las que están hechas para correr por titulares y redes: “creo que es ahora, creo que hemos logrado la AGI”. El problema no fue tanto la frase en sí, sino lo que vino después. Porque cuanto más intentó explicar qué quería decir exactamente, más quedó la sensación de que estaba hablando de otra cosa. No de AGI. Más bien de automatización con esteroides.

El problema no es solo lo que dijo Huang, sino lo fácil que se está volviendo vaciar de sentido la palabra AGI

En el imaginario tecnológico, la AGI no es simplemente una IA “muy buena”. Tampoco un chatbot más convincente ni un ejército de agentes que encadenan tareas. La idea clásica de inteligencia artificial general apunta a algo mucho más ambicioso: un sistema capaz de aprender, razonar, adaptarse y desenvolverse de forma generalista en múltiples dominios, con una flexibilidad parecida (o superior) a la humana. Eso no es lo mismo que tener un modelo que escribe correos, automatiza flujos o lanza una app viral en dos tardes.

Y, sin embargo, ahí es donde el discurso empieza a torcerse. Porque Huang respondió a una pregunta sobre si una IA podría crear, hacer crecer y operar una empresa tecnológica multimillonaria en un plazo de entre cinco y veinte años. En lugar de responder de frente, reformuló el escenario y lo llevó a algo mucho más fácil de vender: que una IA actual ya podría crear un servicio web viral capaz de generar mucho dinero en poco tiempo. O sea, una especie de éxito instantáneo. Algo muy Silicon Valley. Muy llamativo. Y muy distinto de lo que se supone que define a la AGI.

Si el gran ejemplo de tu “AGI” es una IA que alimenta un Tamagotchi, lo que tienes quizá no es AGI sino marketing

Lo más revelador de toda la entrevista no fue la frase grandilocuente, sino los ejemplos que la acompañaron. Huang habló de agentes capaces de construir influencers digitales, automatizar tareas y hasta crear aplicaciones tan absurdamente virales como una que alimente un Tamagotchi por ti. Y sí, claro, eso puede dar dinero. Puede incluso volverse masivo. Pero también deja muy claro el desajuste entre la palabra que se usa y la tecnología que realmente se está describiendo. Porque una cosa es que un sistema sea útil, rápido o rentable. Y otra muy distinta es que sea una inteligencia general.

Hoy los modelos más avanzados siguen dependiendo de arquitecturas que, por impresionantes que sean, continúan basándose en predicción estadística, correlación de patrones y enormes volúmenes de datos. Son muy buenos simulando comprensión en muchos contextos, sí. Pero eso no significa que estén pensando, comprendiendo o razonando como una mente generalista. Ni mucho menos que puedan sostener algo remotamente parecido a una agencia autónoma compleja en el mundo real sin supervisión masiva.

De hecho, el propio Huang matizó la grandilocuencia casi al instante: reconoció que la probabilidad de que 100.000 agentes actuales construyan algo como NVIDIA hoy mismo es “cero por ciento”. Y ahí está el núcleo del problema. Si no puede hacer lo que se supone que define el salto, entonces igual no has dado ese salto.

La industria de la IA lleva tiempo vendiendo la AGI como si estuviera siempre a un trimestre de distancia

Lo de Huang no ocurre en el vacío. Forma parte de un patrón cada vez más evidente en el discurso de las Big Tech. Sam Altman lleva años insinuando que estamos al borde de la AGI. Dario Amodei cree que está cerca. Mark Zuckerberg ha montado equipos y relato alrededor de esa promesa. Elon Musk también juega a ese juego. Y ahora Huang entra en el mismo terreno con una mezcla bastante reconocible de entusiasmo, ambigüedad y corrección posterior.

El truco funciona porque “AGI” es una palabra elástica. Lo suficiente como para que cada ejecutivo la estire hasta donde le convenga en cada entrevista. Si quieres impresionar a inversores, la usas como si fuera un horizonte inminente. Si alguien te aprieta con definiciones, la conviertes en una especie de umbral práctico, flexible, más “económico” que cognitivo. Y así, mágicamente, la AGI siempre está aquí… salvo cuando se le pide que demuestre que de verdad está aquí.

Ese movimiento ya se ha vuelto casi rutina: se anuncia una revolución, se viraliza el titular y después se matiza lo suficiente como para no quedar del todo atrapado por la afirmación original.

El gran agujero sigue siendo el mismo: los modelos actuales son impresionantes, pero siguen pareciendo más loros estadísticos que mentes generales

Aquí conviene poner el pie un poco en el freno, porque tampoco se trata de negar lo evidente: la IA actual es potentísima. Puede escribir, programar, traducir, resumir, sintetizar información, generar imágenes, razonar mejor que hace dos años y actuar en entornos cada vez más complejos. Eso es real. No hace falta quitarle mérito.

Pero también es real que sigue fallando en cosas básicas para una supuesta inteligencia general: consistencia a largo plazo, comprensión causal robusta, fiabilidad, autonomía real, aprendizaje flexible fuera de distribución y una relación estable con la verdad. Si aún estamos peleando con alucinaciones, errores de contexto y comportamientos imprevisibles, hablar de AGI como si ya estuviera sentada en la oficina de al lado suena, como mínimo, prematuro.

Y ahí entra otro debate importante: cada vez más investigadores creen que los modelos de lenguaje, por sí solos, no son el camino completo hacia la AGI. Uno de los más claros en ese punto ha sido Yann LeCun, que lleva tiempo defendiendo que la clave no está solo en el lenguaje, sino en sistemas capaces de construir modelos del mundo, imaginar escenarios, anticipar consecuencias y aprender de forma más parecida a como lo hacemos los humanos.

Eso está muy lejos de lo que tenemos hoy. Muy, muy lejos.

Quizá la AGI llegue algún día, pero ahora mismo lo que tenemos es otra cosa: herramientas poderosas, agentes útiles y mucho humo envuelto en lenguaje mesiánico

Y ese, en el fondo, es el punto incómodo que el discurso de Huang vuelve a poner sobre la mesa.

No estamos viendo todavía una inteligencia artificial general. Estamos viendo una combinación de modelos cada vez más competentes, infraestructura brutal, agentes cada vez más vistosos y una industria con incentivos gigantescos para vender cada pequeño salto como si fuera el definitivo. Eso no significa que no estemos avanzando. Significa que el relato está corriendo más rápido que la tecnología.

La AGI quizá llegue. Puede incluso que llegue por un camino que hoy ni siquiera estamos mirando bien. Pero si el ejemplo estrella que la defiende hoy es una IA que monta una app viral para cuidar un Tamagotchi, quizá todavía no estamos ante la gran revolución cognitiva de la historia. Quizá, simplemente, seguimos en la fase en la que la industria llama “inteligencia general” a cualquier cosa que consiga una buena demo.